Unrealgensyn: La Magia di Creare Video Sintetici per Eventi Umani Rari

Ciao a tutti! Oggi voglio parlarvi di qualcosa di veramente affascinante che sta cambiando il modo in cui addestriamo le intelligenze artificiali, specialmente quando si tratta di capire le azioni umane, anche quelle più strane o rare. Avete mai pensato a quanto sia difficile raccogliere dati video su eventi che capitano raramente, come una caduta accidentale o un piccolo incidente domestico? O magari azioni specifiche che per motivi etici o di privacy non si possono semplicemente filmare a piacimento? Ecco, è un bel problema. Ma noi abbiamo trovato una soluzione piuttosto “wow”: si chiama Unrealgensyn.

Il Problema: Dati Rari, Dati Scarsi

Nel mondo delle azioni umane, c’è di tutto: dalle routine quotidiane agli sport, fino a eventi poco frequenti ma cruciali, come scivolate, collisioni o cadute. Mentre per le azioni comuni abbiamo tonnellate di video (pensate a dataset come UCF101 o Kinetics), per quelle più rare i dati scarseggiano o sono di bassa qualità. Spesso si tratta di scene recitate da attori in ambienti poco realistici. Questo limita parecchio lo sviluppo di sistemi AI affidabili per riconoscere e magari prevenire questi eventi nel mondo reale. Immaginate un sistema di assistenza per anziani: deve essere bravissimo a riconoscere una caduta, ma come fa ad imparare se non ha abbastanza esempi realistici?

La Nostra Soluzione: Unrealgensyn e la Potenza del Sintetico

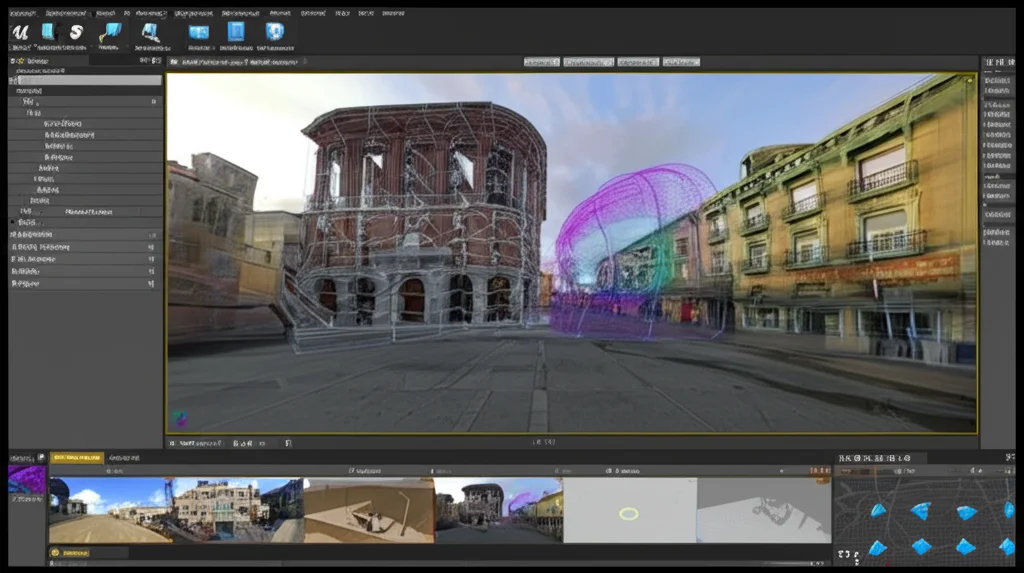

Qui entriamo in gioco noi con Unrealgensyn. Abbiamo sviluppato un framework innovativo, basato sul potentissimo motore grafico Unreal Engine 5, per generare video sintetici di azioni umane in ambienti virtuali iper-realistici. L’idea è semplice ma potente: se non possiamo filmare facilmente certi eventi nel mondo reale, creiamoli nel mondo virtuale!

Ma come funziona? Beh, mettiamo insieme diverse tecnologie all’avanguardia:

- Modelli Generativi di Movimento Guidati dal Testo: Possiamo dire al sistema, tramite un testo, che tipo di azione vogliamo (es. “una persona inciampa e cade all’indietro”). Modelli come MotionCLIP o MDM generano l’animazione dello scheletro umano (in formato SMPL, uno standard nel campo).

- Ricostruzione 3D con Gaussian Splatting (GS): Questa è una tecnologia pazzesca! Permette di ricostruire scene 3D fotorealistiche partendo da semplici video girati con uno smartphone. Prendiamo un video di una stanza reale, lo diamo in pasto a GS e otteniamo un ambiente virtuale dettagliatissimo dentro Unreal Engine. Abbiamo scelto GS perché è efficiente e si integra benissimo con Unreal, meglio di altre tecniche come NeRF che sono più pesanti computazionalmente.

- Avatar MetaHuman: Invece di usare manichini digitali semplici, popoliamo le nostre scene con i MetaHumans di Unreal Engine. Sono avatar incredibilmente realistici, con simulazione di capelli, vestiti e fisica corporea. Questo aggiunge un livello di realismo pazzesco.

Il risultato? Possiamo generare quanti video vogliamo, con diverse azioni, in vari ambienti, da molteplici punti di vista (simulando telecamere di sicurezza, robot assistenti, ecc.). E non solo video a colori (RGB), ma anche dati di profondità (RGB-D), mappe di segmentazione (che identificano i diversi oggetti nella scena) e persino grafici 3D degli oggetti.

![]()

Animazioni dal Reale e dal Testo

Per le animazioni degli avatar, abbiamo due strade. Possiamo prendere un video reale di una persona che compie un’azione e usare modelli come WHAM o VIBE per estrarre il movimento dello scheletro 3D (in formato SMPL). Questo ci dà animazioni molto precise e fluide, anche se a volte soffrono se ci sono occlusioni nel video originale. L’alternativa, come accennato, è usare modelli text-to-motion come MotionCLIP o MDM. Questi generano animazioni direttamente da una descrizione testuale. Il vantaggio è una maggiore variabilità (lo stesso testo può generare animazioni leggermente diverse), anche se a volte la coerenza temporale del movimento può richiedere qualche ritocco. Entrambe le fonti di animazione vengono poi importate in Unreal Engine e applicate ai nostri MetaHumans tramite un processo chiamato “Retargeting”, che adatta l’animazione SMPL alle ossa specifiche dell’avatar.

Scene Iper-realistiche con Gaussian Splatting

La creazione delle scene è uno dei punti forti. Usiamo principalmente Gaussian Splatting. Partiamo da un video di un ambiente reale (una cucina, un soggiorno, un parco…), lo processiamo e otteniamo una “nuvola di punti Gaussiana” che rappresenta la scena in 3D dentro Unreal Engine. Usiamo plugin come quelli di Luma AI o XVERSE per importare questi dati e far sì che la luce interagisca correttamente con la scena ricostruita, proiettando ombre realistiche anche dagli avatar. Il bello è che possiamo anche aggiungere oggetti 3D standard (assets) di Unreal Engine dentro queste scene GS, creando ambienti ibridi ancora più ricchi e interattivi. Immaginate un soggiorno ricostruito con GS, in cui aggiungiamo una sedia specifica su cui l’avatar deve sedersi.

Non Solo Video: Aggiungiamo Contesto con i Grafi Concettuali

Un’altra chicca del nostro framework è la capacità di generare un “grafo concettuale” per ogni scena. Utilizzando il progetto ConceptGraphs, analizziamo la scena 3D (usando i dati RGB-D che possiamo generare sinteticamente) per identificare gli oggetti presenti (tavolo, sedia, TV…), segmentarli e capire le relazioni spaziali e semantiche tra loro (“la sedia è vicino al tavolo”, “la TV è sopra il mobile”). Usiamo modelli potenti come SAM per la segmentazione, CLIP per l’estrazione di feature visive, LLaVA per descrivere gli oggetti e GPT-4 per generare le relazioni. Questo grafo è oro colato! Fornisce un contesto dettagliato della scena che può essere usato per:

- Posizionare gli avatar in modo sensato per l’azione che devono compiere.

- Addestrare modelli AI a capire non solo l’azione, ma anche l’interazione con l’ambiente (Human-Object Interaction).

- Creare dataset multimodali, combinando video e descrizioni testuali ricche generate a partire dal grafo.

![]()

Ma Funziona Davvero? I Test sul Campo (Virtuale)

Ok, tutto bello, ma questi dati sintetici servono a qualcosa? Assolutamente sì! Per dimostrarlo, ci siamo concentrati su un caso d’uso critico: il rilevamento delle cadute. I dataset esistenti (come URFall o MCF) sono limitati: pochi attori, ambienti poco realistici, scarsa varietà. Noi abbiamo creato un dataset sintetico di cadute usando 8 MetaHumans diversi (per genere, corporatura, etnia…), 12 tipi di animazioni di caduta generate con modelli text-to-motion, 8 scene iper-realistiche (interne ed esterne) ricostruite con GS, e 5 punti di vista per scena. Abbiamo generato 210 video RGB-D a 1080p, 30fps.

Poi abbiamo preso un modello di action recognition allo stato dell’arte, VideoMAE, e lo abbiamo addestrato sul dataset UCF101 (che ha 101 classi di azioni comuni, ma non le cadute). Abbiamo aggiunto una nuova classe “Fall” popolandola con dati reali (URFall, MCF) e/o i nostri dati sintetici. I risultati sono stati incredibili!

- Il modello addestrato solo con i nostri dati sintetici ha ottenuto performance altissime (F1-score di 0.95 su URFall e 0.97 su MCF) quando testato su dati reali mai visti prima! Molto meglio dei modelli addestrati solo su un tipo di dato reale e testati sull’altro (che arrivavano a malapena a 0.33).

- Combinare i nostri dati sintetici con i dati reali ha ulteriormente migliorato la capacità del modello di generalizzare tra dataset diversi.

Questo dimostra che i nostri dati sintetici non solo sono realistici, ma aiutano i modelli AI a imparare meglio e a funzionare bene anche in scenari reali diversi da quelli visti in addestramento. Abbiamo anche confrontato la qualità delle mappe di profondità generate dal nostro framework con quelle prodotte da modelli AI specifici come Video-Depthify e Marigold: le nostre sono risultate più dettagliate e generate molto più velocemente.

Punti di Forza e Debolezza

Come tutte le tecnologie, anche Unrealgensyn ha i suoi pro e contro.

Punti di forza:

- Flessibilità e Scalabilità: Possiamo generare tantissimi dati per azioni e scenari diversi.

- Realismo: Grazie a Unreal Engine 5, MetaHumans e Gaussian Splatting.

- Varietà e Riduzione Bias: Usando diversi avatar, aiutiamo a ridurre i bias legati a genere, etnia, ecc.

- Anonimizzazione: Possiamo partire da un video reale, estrarre il movimento e riprodurlo con un avatar sintetico, proteggendo la privacy.

- Superare la Scarsità di Dati: Fondamentale per eventi rari o difficili da registrare.

Limitazioni attuali:

- Interazioni Limitate: Al momento, gli avatar interagiscono principalmente con suolo e muri. L’interazione complessa con oggetti specifici (prendere una tazza, aprire una porta) è un lavoro futuro, che richiederà l’uso dei grafi semantici per segmentare dinamicamente gli oggetti.

- Lavoro Manuale sugli Avatar: Creare e posizionare i MetaHumans richiede ancora un certo lavoro manuale, che può rallentare la generazione su larghissima scala.

- Limiti di Gaussian Splatting: Richiede video di buona qualità che coprano bene tutta la scena. Zone trasparenti o con molti buchi possono creare artefatti. L’illuminazione nel video originale è cruciale.

Conclusioni e Sguardo al Futuro

Insomma, Unrealgensyn è un passo avanti notevole nella generazione di dati sintetici per la comprensione delle azioni umane. Abbiamo dimostrato che i dati creati non solo sono realistici ma migliorano significativamente le performance e la capacità di generalizzazione dei modelli AI, specialmente per eventi rari come le cadute.

Il futuro? Vogliamo migliorare ancora la stabilità e il realismo dei movimenti generati, e soprattutto, implementare interazioni più complesse tra avatar e oggetti, sfruttando i grafi concettuali. Le potenzialità sono enormi: dalla creazione di “gemelli digitali” del comportamento umano all’arricchimento di dataset esistenti per addestrare AI più robuste e affidabili in tantissimi campi, dalla sanità alla robotica. È un viaggio appena iniziato, ma le premesse sono davvero entusiasmanti!

Fonte: Springer