Occhi AI in Classe: Rivoluzioniamo l’Apprendimento con YOLOv8s Migliorato!

Ragazzi, parliamoci chiaro: capire cosa succede davvero in una classe piena di studenti non è una passeggiata. Come insegnanti, o anche solo come osservatori interessati al mondo dell’educazione, sappiamo quanto sia fondamentale cogliere le dinamiche, l’attenzione, la partecipazione. Ma monitorare tutto e tutti in tempo reale? È una sfida enorme! Tradizionalmente ci si affida alla buona vecchia osservazione diretta o alle telecamere, ma diciamocelo, l’occhio umano si stanca, l’efficienza cala e il “tempo reale” diventa un miraggio.

Qui entra in gioco la magia della tecnologia, in particolare l’intelligenza artificiale (AI) e la computer vision. Immaginate un sistema capace di “vedere” e interpretare i comportamenti degli studenti automaticamente, fornendo dati preziosi per migliorare la didattica e l’apprendimento. Sembra fantascienza? Beh, non proprio! La tecnologia di rilevamento dei comportamenti sta facendo passi da gigante, ma non è tutto oro quello che luccica.

La Sfida: Vedere Chiaro nel Caos Controllato di un’Aula

Il problema principale? Le aule sono ambienti complessi. Pensateci:

- Postura Simile: Spesso gli studenti assumono posizioni simili, che stiano leggendo, scrivendo o semplicemente ascoltando. Distinguere queste azioni per un’IA può essere complicato.

- Affollamento e Occlusioni: Nelle classi piene, gli studenti si coprono a vicenda. Rilevare un comportamento specifico quando il soggetto è parzialmente nascosto è una bella gatta da pelare.

- Sfondi Dinamici: L’ambiente cambia, la luce varia, ci sono movimenti continui. L’algoritmo deve essere abbastanza intelligente da non farsi distrarre.

- Velocità vs Precisione: Esistono algoritmi super precisi (come Faster R-CNN) ma lenti, e altri velocissimi (come la famiglia YOLO) ma che a volte sacrificano un po’ di accuratezza. Per un’applicazione in classe, serve il giusto equilibrio: vogliamo risposte rapide, ma anche affidabili.

Negli ultimi anni, molti ricercatori hanno provato a risolvere questi problemi, sviluppando modelli sempre più sofisticati, alcuni basati su meccanismi di attenzione per focalizzarsi sulle informazioni chiave, altri cercando di ottimizzare le reti neurali per renderle più leggere. Tuttavia, spesso si finisce per avere modelli molto complessi, difficili da implementare su larga scala, o che funzionano bene solo su specifici set di dati, senza garanzie sulla loro generalizzazione.

La Nostra Proposta: Potenziare YOLOv8s per la Classe del Futuro

Ed è qui che entriamo in gioco noi! Abbiamo pensato: perché non prendere uno degli algoritmi più promettenti per il rilevamento di oggetti in tempo reale, il famoso YOLOv8s (una versione agile e performante della famiglia YOLO), e dargli una marcia in più, specificamente per l’ambiente scolastico?

Il nostro obiettivo era chiaro: migliorare l’accuratezza nel riconoscere comportamenti come alzare la mano, leggere e scrivere, mantenendo al contempo un’efficienza computazionale che permettesse un’analisi quasi istantanea. Come ci siamo riusciti? Introducendo due moduli innovativi nel cuore di YOLOv8s:

MLKCM: Vedere a Diverse Scale, Come un Occhio Esperto

Il primo è il Multi-scale Large Kernel Convolution Module (MLKCM). Immaginatelo come la capacità di avere contemporaneamente una visione d’insieme e un focus sui dettagli. Utilizzando “kernel” (una sorta di lenti di ingrandimento digitali) di dimensioni diverse e combinandoli con una tecnica chiamata “multi-axis pooling”, questo modulo permette alla rete neurale di catturare informazioni a varie scale spaziali. In pratica, aiuta l’algoritmo a capire meglio il contesto generale e, allo stesso tempo, a non perdersi i dettagli fini di un gesto, come una mano alzata timidamente. Questo rende la rete più sensibile alle caratteristiche rilevanti, anche in scene affollate o complesse.

PFOM: Ottimizzare le Informazioni, Passo Dopo Passo

Il secondo asso nella manica è il Progressive Feature Optimization Module (PFOM). Questo modulo lavora in modo intelligente sulle informazioni estratte. Divide i “canali” di dati (pensateli come diversi tipi di informazioni visive), ne conserva una parte “raffinata” e ottimizza progressivamente l’altra parte usando blocchi leggeri e ripetibili. È come se l’algoritmo imparasse a concentrarsi sempre meglio sulle informazioni locali (il singolo studente) e globali (la dinamica della classe) più importanti, scartando il rumore di fondo. Il tutto in modo efficiente, senza appesantire troppo il modello.

Alla Prova dei Fatti: I Risultati Parlano Chiaro

Naturalmente, non ci siamo fermati alla teoria. Abbiamo messo alla prova il nostro YOLOv8s “vitaminizzato” su due dataset pubblici specifici per il comportamento degli studenti in classe: SCB-Dataset3-S e SCB-Dataset3-U. Questi dataset contengono migliaia di immagini con annotazioni per le azioni di interesse: alzare la mano, leggere e scrivere.

I risultati? Strepitosi! Sul dataset SCB-Dataset3-S, abbiamo raggiunto una precisione media (mAP) del 76.5%, superando altri metodi di rilevamento molto diffusi, inclusa la versione base di YOLOv8s e persino modelli più recenti come YOLOv9-s. Anche sul secondo dataset (SCB-Dataset3-U), abbiamo ottenuto un eccellente 95.0% di mAP, confermando la robustezza e la capacità di generalizzazione del nostro approccio.

Abbiamo anche condotto esperimenti “di ablazione”, cioè testando il modello con e senza i nostri moduli MLKCM e PFOM. I risultati hanno dimostrato inequivocabilmente che entrambi i moduli contribuiscono significativamente al miglioramento delle performance. L’MLKCM da solo ha portato un aumento del mAP del 2.1%, mentre l’aggiunta del PFOM ha ulteriormente incrementato la precisione dell’1.4%.

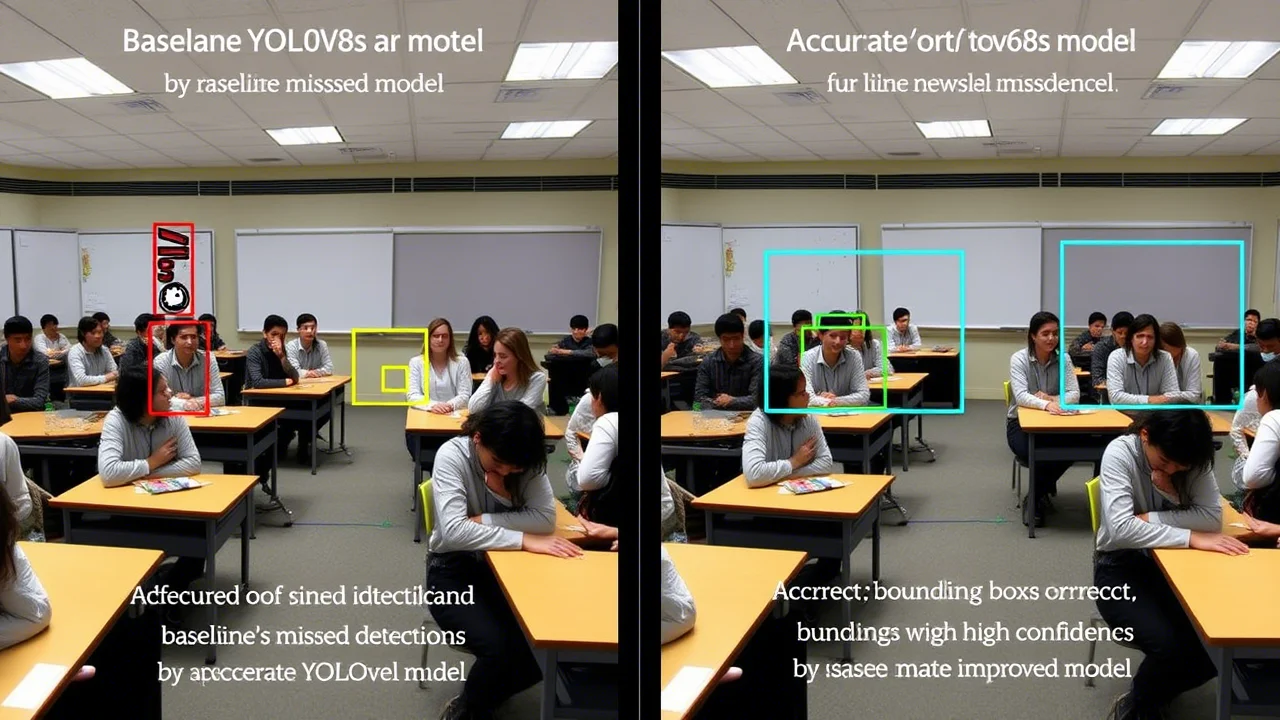

Vedere per Credere: La Visualizzazione dei Risultati

Ma i numeri, si sa, a volte sono freddi. Abbiamo quindi visualizzato i risultati del nostro modello confrontandoli con quelli del YOLOv8s standard. Le immagini sono eloquenti: il nostro sistema è decisamente più bravo a individuare correttamente gli studenti e le loro azioni, specialmente in situazioni difficili. Ad esempio, riesce a distinguere meglio tra lettura e scrittura (pose molto simili) e a non “perdere” studenti che magari alzano la mano in modo meno evidente, cosa che invece accadeva con il modello base. Questa robustezza è fondamentale per un’applicazione reale.

Implicazioni per l’Educazione e Prossimi Passi

Cosa significa tutto questo per il futuro dell’educazione? Le potenzialità sono enormi. Un sistema come il nostro potrebbe:

- Fornire agli insegnanti feedback oggettivi e in tempo reale sul livello di attenzione e partecipazione della classe.

- Aiutare a identificare studenti che potrebbero aver bisogno di supporto aggiuntivo.

- Contribuire a personalizzare l’esperienza didattica basandosi su dati concreti.

- Offrire strumenti di analisi per la ricerca pedagogica.

Il nostro approccio, essendo basato su un modello efficiente come YOLOv8s e ulteriormente ottimizzato, è pensato per essere leggero e veloce, rendendo possibile un monitoraggio in tempo reale senza richiedere risorse hardware proibitive.

Certo, siamo consapevoli che c’è ancora strada da fare. I dataset attuali, per quanto utili, potrebbero non coprire tutte le possibili varianti di illuminazione, occlusioni o pose che si incontrano nel mondo reale. Inoltre, sebbene le prestazioni siano ottime, c’è sempre margine per ottimizzare ulteriormente la velocità e ridurre le dimensioni del modello per una più facile implementazione su dispositivi meno potenti.

Per questo, i nostri prossimi passi includeranno la creazione di dataset ancora più ampi e variegati e test rigorosi in ambienti scolastici reali. Vogliamo assicurarci che il nostro “occhio AI” sia non solo intelligente, ma anche affidabile e veramente utile nella pratica quotidiana.

Insomma, siamo entusiasti dei risultati raggiunti. Crediamo che combinare l’intelligenza artificiale con una profonda comprensione delle sfide specifiche dell’ambiente educativo possa davvero fare la differenza, aprendo la strada a sistemi di supporto alla didattica più efficaci e personalizzati. Il futuro dell’apprendimento potrebbe essere molto più “consapevole” grazie a queste tecnologie!

Fonte: Springer