Reti Attentive Deformabili: La Nuova Frontiera AI per Scovare i Globuli Bianchi

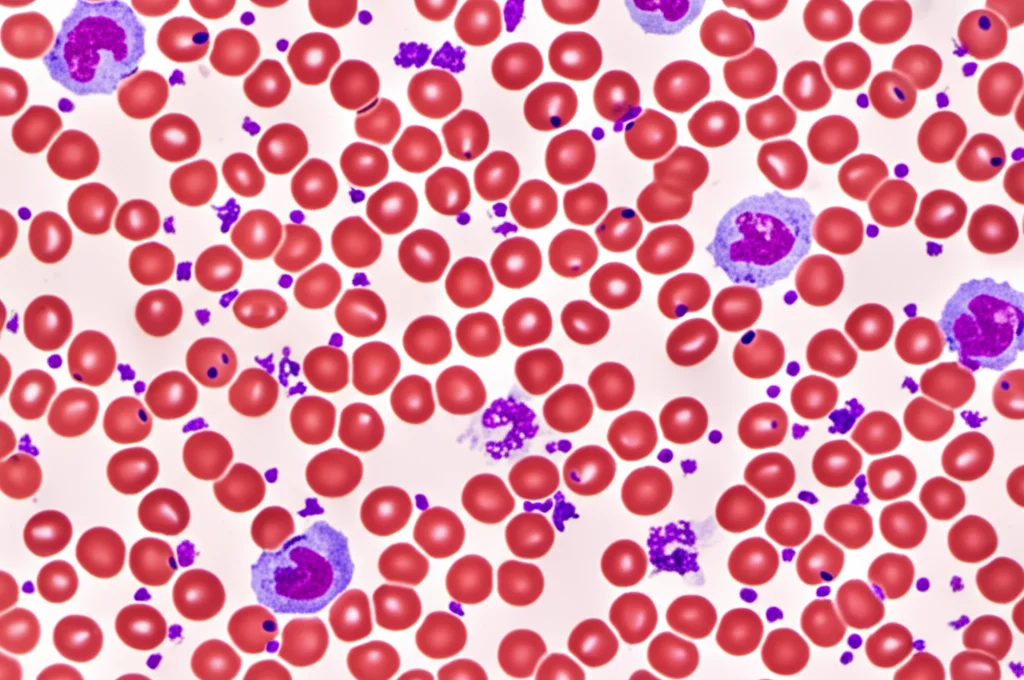

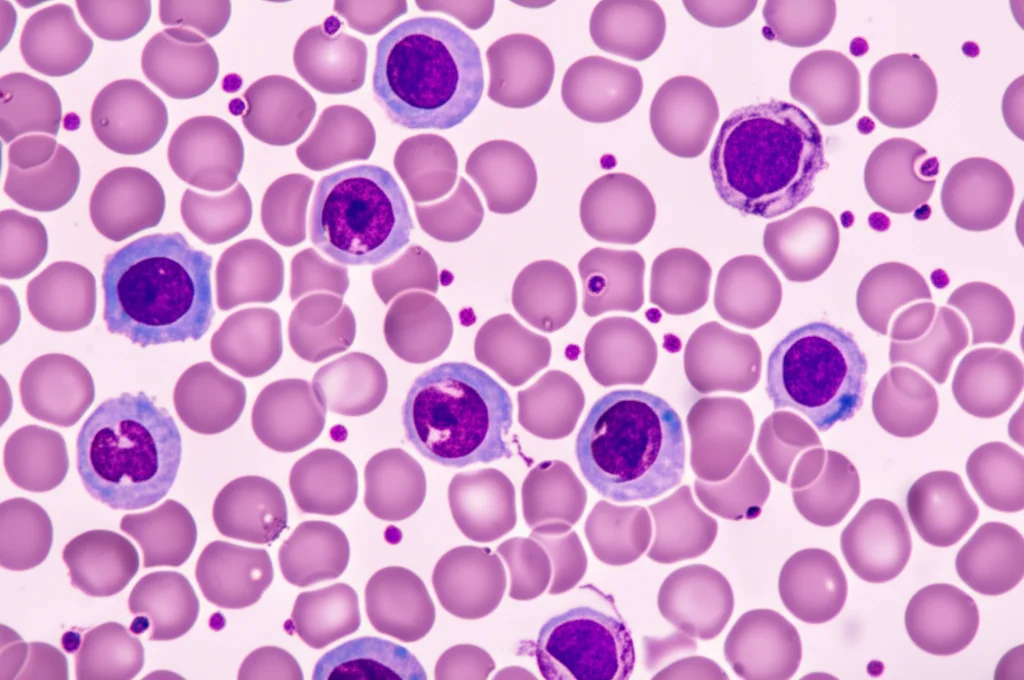

Ciao a tutti! Oggi voglio parlarvi di qualcosa che mi appassiona tantissimo: come l’intelligenza artificiale sta cambiando il volto della medicina, in particolare nel campo dell’analisi del sangue. Avete presente i globuli bianchi (WBC)? Sono i nostri piccoli soldati, fondamentali per capire se c’è un’infezione, un’infiammazione o persino alcuni tipi di cancro. Identificarli e contarli, però, è un lavoraccio!

La Sfida: Occhi Stanchi e Limiti Tecnologici

Tradizionalmente, l’analisi dei globuli bianchi viene fatta al microscopio da tecnici esperti. È un processo lungo, meticoloso e, diciamocelo, un po’ noioso e soggetto a stanchezza. Qui entra in gioco l’AI! Le Reti Neurali Convoluzionali (CNN) sono state le prime ad arrivare sulla scena. Sono bravissime a “vedere” e riconoscere pattern nelle immagini, quindi perfette per identificare cellule. Ma hanno un limite: faticano a cogliere il quadro generale, le relazioni a distanza tra le varie parti dell’immagine. È come guardare un puzzle concentrandosi solo su un pezzetto alla volta.

Poi sono arrivati i Transformers, famosi nel mondo del linguaggio naturale, ma che si sono rivelati potenti anche con le immagini. Loro sì che sanno gestire le dipendenze a lungo raggio, capendo il contesto globale. Però, anche loro hanno i loro “contro”: richiedono una marea di dati per allenarsi (e in medicina i dati non sono sempre così abbondanti) e sono computazionalmente “pesanti”, cioè richiedono molta potenza di calcolo.

Inoltre, le immagini dei globuli bianchi sono particolarmente ostiche:

- Le tecniche di colorazione possono variare.

- Le condizioni di illuminazione cambiano.

- Spesso le cellule si appiccicano tra loro (adesione multicellulare).

- Ci sono grandi differenze tra il primo piano (le cellule) e lo sfondo.

- Le cellule stesse hanno dimensioni diverse.

Insomma, un bel rompicapo per qualsiasi algoritmo!

La Nostra Idea: Unire le Forze con MCDAF-Net

Di fronte a queste sfide, ci siamo chiesti: perché non prendere il meglio dei due mondi? Ed è così che è nata la nostra creatura: MCDAF-Net (Multi-Scale Cross-Deformation Attention Fusion Network). È una rete ibrida che combina la capacità delle CNN di estrarre caratteristiche gerarchiche con l’abilità dei Transformers di modellare le relazioni a lungo raggio. Ma non ci siamo fermati qui! Abbiamo introdotto un paio di assi nella manica.

Gli Ingredienti Segreti: AMSM e CDCM

Per affrontare specificamente i problemi delle immagini dei globuli bianchi, abbiamo progettato due moduli innovativi:

1. AMSM (Attention Multi-scale Sensing Module): Immaginate di dare all’AI diversi tipi di “lenti” per guardare l’immagine: alcune per i dettagli fini, altre per una visione più ampia. L’AMSM fa proprio questo! Usa convoluzioni dilatate, orizzontali e verticali per catturare caratteristiche a scale diverse. Poi, grazie a un meccanismo di auto-attenzione (self-attention), capisce quali di queste caratteristiche sono più importanti e si concentra su quelle. Questo aiuta a localizzare i globuli bianchi con molta più precisione, anche se hanno dimensioni diverse.

2. CDCM (Cross-Deformation Convolution Module): A volte, le informazioni estratte possono essere un po’ ridondanti, come sentire la stessa nota suonata da strumenti diversi. Il CDCM serve a “ripulire” queste ridondanze tra i canali delle caratteristiche. Utilizza una strategia che abbiamo chiamato ‘Split-Crossover-Fusion Deformation’. In pratica, divide le informazioni, le incrocia in modo intelligente e poi le fonde, aiutando il modello a distinguere meglio tra cellule diverse, anche quelle appiccicate tra loro. È come districare dei fili aggrovigliati per vedere meglio ogni singolo filo.

Mettere Tutto Insieme (e Altri Dettagli Tecnici)

La struttura generale di MCDAF-Net prevede:

- Un “backbone” basato su ResNet50 (una CNN collaudata) per estrarre le caratteristiche iniziali.

- Il nostro modulo MCDAF (che contiene AMSM e CDCM, più un modulo ADP per l’efficienza) per raffinare queste caratteristiche.

- Una struttura Transformer per analizzare il contesto globale e le relazioni a lungo raggio.

- L’uso della funzione di perdita DIOU loss, che è particolarmente brava a gestire i casi in cui le cellule si sovrappongono nei riquadri di rilevamento (bounding box).

Abbiamo allenato e testato la nostra rete usando PyTorch su una GPU NVIDIA RTX 3090, sfruttando tecniche come il transfer learning (partendo da un ResNet50 pre-allenato), l’aumento dei dati (ruotando, capovolgendo, modificando contrasto/luminosità delle immagini per rendere il modello più robusto) e l’early stopping per evitare che imparasse troppo a memoria i dati di allenamento (overfitting).

Il Momento della Verità: I Risultati!

Ebbene, come si è comportata MCDAF-Net? L’abbiamo messa alla prova su diversi set di dati pubblici ben noti nel campo (LISC, BCCD, WBCDD) e anche su un nostro set di dati privato (RSLI). I risultati sono stati davvero incoraggianti!

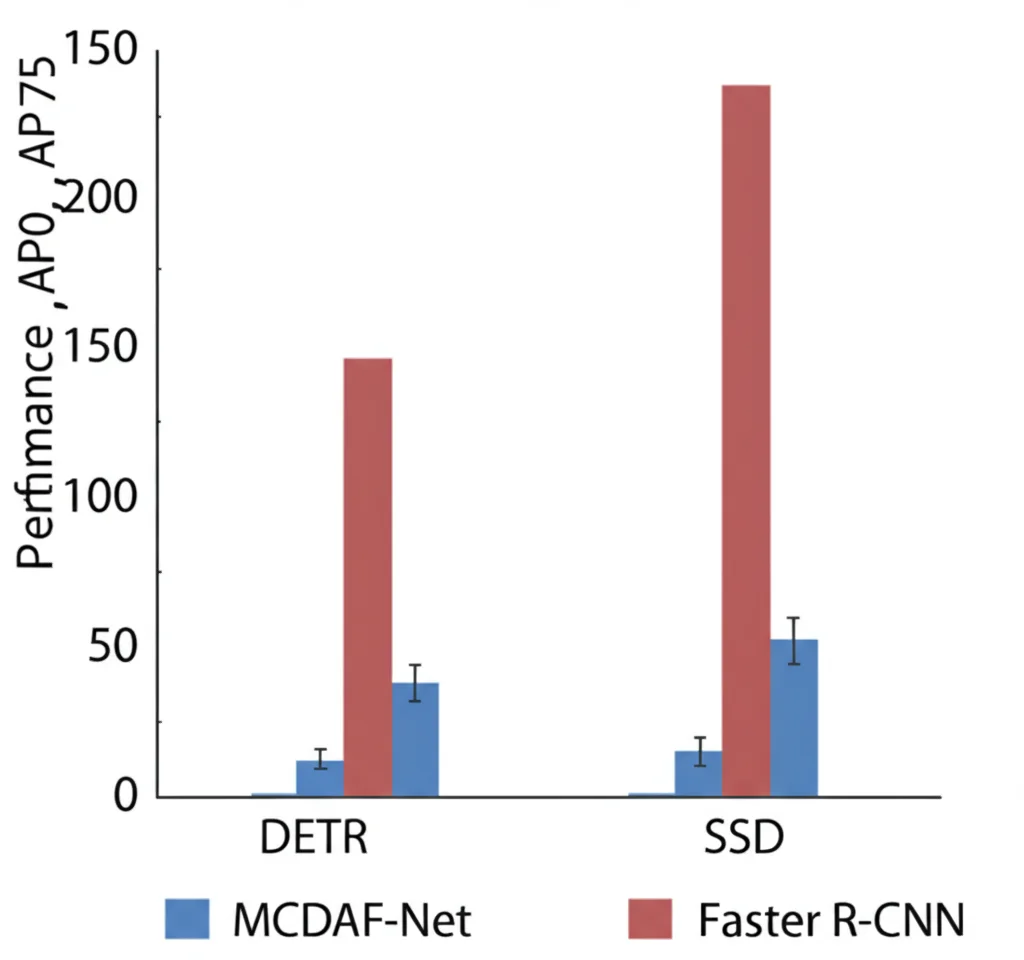

Abbiamo confrontato le performance di MCDAF-Net con altri modelli di rilevamento oggetti, sia basati su CNN (come Faster R-CNN, RetinaNet, SSD, TE-YOLOF) che su Transformer (DETR, Deformable-DETR, DINO-DETR) e altri ancora (YOLOv1, D-FINE).

Su tutti i dataset, la nostra MCDAF-Net ha mostrato prestazioni superiori, specialmente usando metriche standard come AP (Average Precision), AP50 e AP75 (AP calcolate con soglie di sovrapposizione del 50% e 75%). Ad esempio, sul dataset LISC, abbiamo ottenuto miglioramenti significativi rispetto a modelli come DETR e SSD. Anche su BCCD e WBCDD, MCDAF-Net si è dimostrata la migliore o tra le migliori, gestendo bene anche le classi di cellule meno frequenti o con caratteristiche morfologiche particolari.

Abbiamo anche condotto studi di “ablazione”, cioè abbiamo testato la rete rimuovendo uno alla volta i nostri moduli (AMSM, CDCM) per verificare il contributo di ciascuno. I risultati hanno confermato che ogni componente aggiunge valore e che la combinazione completa è quella che dà le performance migliori. Abbiamo persino ottimizzato i “tassi di dilatazione” usati nell’AMSM per trovare la combinazione perfetta!

Perché è Importante e Cosa C’è Dopo?

Questo lavoro dimostra che combinare intelligentemente CNN e Transformer, e aggiungendo moduli specifici come AMSM e CDCM, possiamo superare molti dei limiti attuali nel rilevamento automatico dei globuli bianchi. La capacità di gestire la variabilità di scala e la ridondanza delle caratteristiche è cruciale per ottenere risultati accurati e affidabili, specialmente in un contesto clinico dove la precisione è tutto.

Certo, c’è ancora strada da fare. Il nostro modello, pur essendo performante, ha ancora un numero considerevole di parametri. Una delle direzioni future è sviluppare versioni più “leggere” (lightweight) per migliorare l’efficienza computazionale. Inoltre, vorremmo rendere il modulo AMSM ancora più intelligente, magari capace di adattare automaticamente i tassi di dilatazione in base al dataset, senza bisogno di regolazioni manuali.

In Conclusione

Siamo davvero entusiasti dei risultati ottenuti con MCDAF-Net. Crediamo che questo approccio ibrido e multi-scala rappresenti un passo avanti significativo per l’analisi automatizzata delle immagini mediche, in particolare per il compito fondamentale del rilevamento dei globuli bianchi. Speriamo che il nostro lavoro possa contribuire a rendere le diagnosi più rapide, precise e meno faticose per gli operatori sanitari. La fusione tra intelligenza umana e artificiale continua a regalarci strumenti potentissimi!

Fonte: Springer