PlantCareNet: Il Tuo Dottore Digitale per Piante Malate (Con Consigli Infallibili!)

Ciao a tutti, appassionati di tecnologia e amanti del verde! Oggi voglio parlarvi di qualcosa che mi sta davvero a cuore: come possiamo usare l’intelligenza artificiale per dare una mano concreta all’agricoltura, un settore fondamentale per tutti noi. Sapete, le malattie delle piante sono un bel problema: non solo riducono i raccolti, mettendo a rischio la sicurezza alimentare, ma costringono spesso gli agricoltori a usare tanti prodotti chimici. E se vi dicessi che abbiamo sviluppato un sistema super avanzato per diagnosticare queste malattie in un lampo e offrire anche consigli su come prevenirle? Si chiama PlantCareNet, e lasciate che vi racconti come funziona.

Perché un “Dottore Digitale” per le Piante?

Pensateci: l’agricoltura dà da vivere a 2,5 miliardi di persone nel mondo! È la spina dorsale di molte economie, specialmente nei paesi in via di sviluppo come il Bangladesh, dove dà lavoro a oltre il 40% della popolazione e contribuisce significativamente al PIL. Ma questo settore è fragile. Cambiamenti climatici, instabilità economica e, appunto, le malattie delle piante, possono mettere in ginocchio intere comunità. In Bangladesh, ad esempio, si stima che le malattie possano causare perdite del 20-30% su colture essenziali come riso e grano. Identificare e trattare queste malattie in tempo può ridurre le perdite fino al 70% e diminuire l’uso di pesticidi, che sono costosi e dannosi per l’ambiente. Ecco perché servono strumenti intelligenti e accessibili.

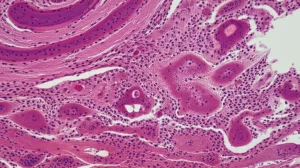

Negli ultimi anni, l’intelligenza artificiale (AI) e il machine learning, in particolare le tecniche di deep learning, hanno fatto passi da gigante. Immaginate di poter scattare una foto a una foglia malata con il vostro smartphone e ricevere subito una diagnosi accurata e consigli su cosa fare. Fantascienza? Non più! Modelli come le Reti Neurali Convoluzionali (CNN) sono bravissimi ad analizzare immagini, riconoscendo colori, forme e texture tipiche delle varie malattie, spesso con precisioni superiori al 97%. Però, c’è un “ma”. Questi modelli sono spesso pesanti, richiedono tanta potenza di calcolo e grandi quantità di dati, risorse non sempre disponibili, specialmente nelle aree rurali del Bangladesh. Inoltre, fattori come la luce, lo stadio della pianta o della malattia possono complicare le cose.

Ecco PlantCareNet: Diagnosi Veloce e Consigli su Misura

È qui che entra in gioco il nostro PlantCareNet. Abbiamo pensato: “Come possiamo creare un sistema che sia super preciso ma anche leggero, veloce e facile da usare, magari direttamente su uno smartphone?”. La nostra idea è stata quella di sviluppare un’architettura CNN ottimizzata, capace di analizzare le immagini delle foglie malate e classificarle tra 35 diverse malattie comuni in Bangladesh, riguardanti colture cruciali come riso, grano, pomodoro, patata, mais, cavolfiore e melanzana.

Ma non ci siamo fermati alla diagnosi. PlantCareNet offre subito dopo due tipi di raccomandazioni:

- Modalità Riferimento (Ref Mode): Fornisce informazioni chiare e concise basate su conoscenze esperte sui sintomi, la prevenzione e la cura della malattia identificata. Una sorta di “bugiardino” smart.

- Modalità LLM (LLM Mode): Utilizza modelli linguistici avanzati (come GPT) per offrire consigli dinamici, personalizzati e contestualizzati, quasi come parlare con un esperto agronomo virtuale.

Il bello è che entrambe le opzioni sono immediate. L’agricoltore scatta la foto, ottiene la diagnosi e riceve subito indicazioni pratiche.

La Nostra Arma Segreta: Un Dataset “Fatto in Casa” (o quasi!)

Uno dei punti di forza di PlantCareNet è il dataset che abbiamo costruito. Per insegnare a un’AI a riconoscere le malattie, servono tantissime immagini. Noi ne abbiamo raccolte e annotate oltre 30.000! Ma non ci siamo limitati a prendere database esistenti. Abbiamo unito dati da fonti internazionali autorevoli (come PlantVillage) con dati specifici del Bangladesh, concentrandoci sulle 35 malattie più rilevanti per 7 colture chiave in quella regione. Questo rende il nostro modello particolarmente “sintonizzato” sulla realtà agricola locale.

Abbiamo curato ogni dettaglio: le immagini mostrano le malattie in vari stadi, con diverse condizioni di luce e da diverse angolazioni. Poi, le abbiamo pre-processate: ridimensionate (prima a 640×640, poi a 75×75 pixel per il nostro modello), normalizzate (per gestire differenze di luminosità) e “aumentate”. Cosa significa “aumentate”? Abbiamo applicato piccole modifiche casuali alle immagini (rotazioni, zoom, flip orizzontali…) durante l’allenamento. È come se mostrassimo al modello la stessa foglia malata da tante prospettive diverse, rendendolo più robusto e capace di generalizzare, cioè di riconoscere la malattia anche in foto non perfette prese sul campo.

Sotto il Cofano di PlantCareNet: Leggerezza ed Efficienza

Abbiamo progettato l’architettura di PlantCareNet pensando all’efficienza. Volevamo qualcosa che potesse girare bene anche su dispositivi mobili, senza sacrificare troppo la precisione. La nostra CNN usa strati convoluzionali standard per estrarre le caratteristiche importanti dalle immagini, funzioni di attivazione ReLU (che sono veloci), Batch Normalization (per stabilizzare l’allenamento), Max-Pooling (per ridurre la dimensione dei dati mantenendo le informazioni essenziali) e Dropout (una tecnica furbissima per evitare che il modello impari “a memoria” le immagini di training e non sappia poi riconoscere quelle nuove). Il risultato? Un modello con “solo” 5 milioni di parametri (pochissimi rispetto ai giganti come ResNet50 che ne hanno quasi 25 milioni!) e un tempo di inferenza medio (il tempo per fare una diagnosi) di appena 0.0021 secondi per immagine!

I Risultati? Parliamo di Numeri!

E la precisione? Beh, siamo molto soddisfatti. Sul nostro dataset personalizzato, PlantCareNet ha raggiunto un’accuratezza, precisione, recall e F1-score del 97%! Abbiamo confrontato le sue performance con modelli famosi come InceptionV3 e ResNet50 su diversi dataset pubblici (PlantVillage, VegNet, etc.). PlantCareNet ha spesso ottenuto risultati migliori o comparabili, dimostrando la sua efficacia e versatilità. Ad esempio, sul dataset PlantVillage ha ottenuto il 94% di accuratezza, superando gli altri due.

Certo, ci sono state sfide. Alcune malattie sono visivamente molto simili tra loro, o avevamo meno immagini per alcune classi (un problema noto come “class imbalance”). Abbiamo usato tecniche come la data augmentation e la pesatura delle classi durante l’allenamento per mitigare questo problema, e i risultati sono stati incoraggianti. Per capire *come* il modello prende le decisioni, abbiamo usato una tecnica chiamata Grad-CAM, che crea delle “mappe di calore” sull’immagine, evidenziando le aree che il modello considera più importanti per la diagnosi. E abbiamo visto che PlantCareNet si concentra proprio sulle zone malate, il che aumenta la nostra fiducia nella sua affidabilità.

L’App Mobile: PlantCareNet a Portata di Mano

Tutta questa tecnologia doveva essere resa accessibile. Per questo abbiamo sviluppato un’applicazione mobile per Android (usando Kotlin). L’interfaccia è semplice: l’utente sceglie il tipo di coltura, scatta una foto o ne carica una dalla galleria, e invia l’immagine al nostro sistema (attualmente ospitato su Roboflow tramite un’API RESTful). In pochi secondi, l’app mostra il nome della malattia diagnosticata, il livello di confidenza della diagnosi e le raccomandazioni (in modalità Ref o LLM, a scelta dell’utente).

L’app è progettata per essere leggera e funzionare bene anche su smartphone non potentissimi. Abbiamo ottimizzato il consumo di memoria (circa 90MB quando attiva), il tempo di avvio (1.5 secondi) e il consumo di batteria e dati (bassissimi!). Se il modello non è sicuro della diagnosi o incontra una malattia non prevista, lo segnala come “sconosciuto”, per evitare errori. Si possono anche caricare più foto della stessa pianta per migliorare l’accuratezza.

Modalità Riferimento vs. Modalità LLM: Due Livelli di Aiuto

La vera innovazione sta forse nel sistema di raccomandazioni a due modalità.

- La Ref Mode è il punto di partenza: veloce, affidabile, basata su conoscenze consolidate. Ti dice i sintomi chiave, le pratiche preventive standard e i trattamenti comuni per quella specifica malattia. Ottimo per un riferimento rapido.

- La LLM Mode è il livello successivo. Qui entra in gioco la potenza di GPT. L’AI analizza il contesto (tipo di coltura, malattia, magari anche dati locali se disponibili in futuro) e genera consigli più dettagliati, personalizzati e aggiornati. Può suggerire fungicidi specifici, metodi di applicazione, tempistiche basate sulle condizioni locali, e persino dare consigli preventivi se la pianta è sana. È come avere un consulente sempre disponibile.

Abbiamo anche confrontato le raccomandazioni generate dal nostro sistema (in LLM mode) con quelle curate da esperti umani. I risultati sono stati ottimi, con un’alta similarità sia nel contenuto generale (oltre 84%) che nella terminologia tecnica specifica (oltre 82%). C’è ancora margine per migliorare la precisione del linguaggio tecnico, ma la strada è quella giusta!

Confronto con l’Esistente e Sguardo al Futuro

Abbiamo messo alla prova la nostra app confrontandola con altre app simili disponibili sul mercato (come Plantix, PlantParent, Agrio) in termini di prestazioni: dimensione dell’app, tempo di caricamento, uso della rete, della memoria e della CPU. PlantCareNet si è dimostrata molto competitiva, spesso più leggera ed efficiente, specialmente nell’uso dei dati di rete, un fattore cruciale in aree con connettività limitata.

Questo progetto, PlantCareNet, è il nostro contributo per rendere l’agricoltura più sostenibile e resiliente. Crediamo che mettendo strumenti potenti ma accessibili nelle mani degli agricoltori, possiamo fare una differenza reale. Certo, il lavoro non finisce qui. Stiamo già pensando ai prossimi passi: integrare modelli vision-language (che capiscono sia immagini che testo), migliorare la gestione di immagini di bassa qualità, e ottimizzare ulteriormente il modello per farlo girare direttamente sui dispositivi (edge computing), riducendo la dipendenza dal cloud.

L’obiettivo finale è ambizioso: contribuire a garantire la sicurezza alimentare globale, supportando chi lavora la terra ogni giorno con il meglio che la tecnologia può offrire. E noi siamo entusiasti di far parte di questa rivoluzione!

Fonte: Springer