Svelando i Segreti degli Operatori Quasiperiodici: Un Viaggio tra Localizzazione e Gap Spettrali

Ciao a tutti, appassionati di misteri matematici e fisici! Oggi voglio portarvi con me in un’avventura nel cuore di certi oggetti matematici un po’ bizzarri ma incredibilmente affascinanti: gli operatori quasiperiodici. Immaginate di camminare su un sentiero che non è perfettamente regolare come una strada asfaltata (periodico), ma nemmeno completamente caotico come un bosco selvaggio (casuale). Ecco, i sistemi quasiperiodici sono un po’ così, una via di mezzo che nasconde sorprese incredibili.

Cosa Sono Questi Operatori e Perché Ci Interessano?

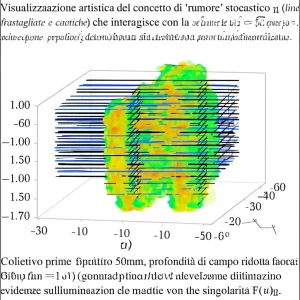

Nel nostro caso, stiamo parlando di operatori che agiscono su uno spazio chiamato (ell^2(mathbb{Z}^d)). Non fatevi spaventare dalla notazione! Pensatelo come un reticolo infinito in (d) dimensioni (immaginate una griglia, per capirci), e su ogni punto di questa griglia c’è un valore. L’operatore che studiamo è una sorta di “macchina” che prende una configurazione di questi valori e ne restituisce un’altra. È definito come (H(x) = varepsilonDelta + V_x). Qui, (Delta) è il cosiddetto Laplaciano discreto, che rappresenta il “salto” (o hopping) di una particella da un sito all’altro del reticolo, con (varepsilon) che ne modula l’intensità. La parte davvero interessante è (V_x), il potenziale. In un sistema quasiperiodico, questo potenziale non si ripete esattamente come in un cristallo, ma segue uno schema dettato da una funzione (f) (che nel nostro studio è monotona, cioè sempre crescente o decrescente) e da un vettore di frequenze (omega), in modo che il valore del potenziale nel sito ({textbf{n}}) sia (f(x + {textbf{n}}cdotomega)).

Il nostro obiettivo? Capire come sono fatti lo spettro (cioè l’insieme degli autovalori, o energie permesse) e le autofunzioni (gli stati corrispondenti) di questi operatori, specialmente quando l’hopping (varepsilon) è piccolo. È un po’ come cercare di capire quali note può suonare uno strumento musicale molto complesso e come vibrano le sue corde.

La Sfida: Potenziali Monotoni e Piccoli Denominatori

Lavorare con potenziali monotoni, come quelli che abbiamo considerato (ad esempio, funzioni (alpha)-Hölder monotone, che hanno una certa regolarità), introduce delle particolarità. Un esempio famoso è il modello di Maryland, dove (f(x) = cot(pi x)). Questi potenziali possono avere discontinuità, il che rende le cose più complicate rispetto a potenziali più “lisci”.

Quando si cerca di “diagonalizzare” l’operatore, cioè di trovare una base in cui esso diventa una semplice matrice diagonale (i cui elementi sono gli autovalori), si incappa spesso nei famigerati “piccoli denominatori”. Sono termini che diventano molto piccoli e possono far divergere le nostre approssimazioni. È qui che entra in gioco la nostra strategia.

La Nostra Arma Segreta: Diagonalizzazione Perturbativa Iterativa

Per affrontare queste sfide, abbiamo sviluppato uno schema iterativo che possiamo pensare come una versione “locale” e convergente della diagonalizzazione di tipo KAM (Kolmogorov-Arnold-Moser), una tecnica potente usata in sistemi dinamici. Immaginate di dover accordare uno strumento molto sensibile: non lo fate tutto in una volta, ma con piccoli aggiustamenti successivi. Il nostro metodo funziona in modo simile:

- Partiamo dal nostro operatore (H(x)).

- Applichiamo una serie di trasformazioni unitarie (come delle “rotazioni” intelligenti nello spazio delle funzioni) (U^{(s)}), passo dopo passo. Ogni trasformazione è una piccola perturbazione dell’identità.

- L’idea è che, ad ogni passo (s), l’operatore trasformato (H^{(s+1)} = (U^{(s+1)})^{-1} H^{(s)} U^{(s+1)}) diventi “sempre più diagonale” rispetto a un certo sito di riferimento (diciamo, l’origine ({textbf{0}})).

La chiave è che non miriamo subito a una diagonalizzazione completa, ma a una parziale diagonalizzazione che isoli gradualmente un autospazio unidimensionale. Questo ci dà più flessibilità e riduce il numero di piccoli denominatori da controllare simultaneamente. La monotonia della funzione (f) originale è cruciale all’inizio, ma il procedimento iterativo non la preserva esattamente. Qui, un trucco combinatorio, legato al conteggio degli autovalori in volumi finiti, ci aiuta a mantenere un controllo sulla “quasi-monotonia” degli elementi diagonali che emergono.

Risultato Principale: Localizzazione di Anderson e Spettro Puro Puntuale

Cosa abbiamo scoperto con questo metodo? Per valori sufficientemente piccoli dell’hopping (varepsilon) e per frequenze (omega) “debolmente Diofantine” (una condizione tecnica che evita i peggiori piccoli denominatori), riusciamo a dimostrare la localizzazione di Anderson. Questo significa che:

- Esiste una base ortonormale di autofunzioni (psi_{textbf{n}}(x)) per il nostro operatore (H(x)).

- Queste autofunzioni sono uniformemente localizzate esponenzialmente. Immaginatele come delle “gobbe” concentrate attorno a un sito specifico ({textbf{n}}) del reticolo, che decadono molto rapidamente man mano che ci si allontana. Fisicamente, questo implica che una particella descritta da tale autofunzione è intrappolata vicino a quel sito.

- Lo spettro di (H(x)) è puro puntuale e semplice. Significa che è composto interamente da autovalori isolati, ognuno con una sola autofunzione (a meno di multipli scalari).

In pratica, abbiamo trovato una famiglia covariante di autovalori (E(x)) e autofunzioni (psi(x)) che sono ben definite e si comportano in modo regolare. La funzione (E(x)) che mappa la “fase” (x) all’autovalore corrispondente risulta essere strettamente crescente. Se la (f) originale era Lipschitz monotona (un tipo specifico di monotonia), anche (E(x)) lo è.

Non Solo Localizzazione: La Scoperta di Infiniti Gap Spettrali

Ma non è tutto! Un’altra domanda fondamentale per questi operatori è se il loro spettro presenti dei “buchi”, chiamati gap spettrali. Si tratta di intervalli di energia in cui non esistono autovalori. Per una classe particolare di potenziali monotoni, che abbiamo chiamato “sawtooth-type” (potenziali a dente di sega, continui su [0,1) e limitati), abbiamo dimostrato qualcosa di ancora più forte.

Sotto le stesse condizioni di piccolo (varepsilon) e frequenze (omega) adatte, abbiamo provato che lo spettro di (H(x)) contiene infinitamente tanti gap. Inoltre, lo spettro della restrizione dell’operatore (H(0)) a un sottospazio ciclico specifico (generato a partire dal vettore (e_{textbf{0}})) è un insieme di Cantor. Un insieme di Cantor è un oggetto frattale affascinante, pieno di “buchi” a tutte le scale!

La dimostrazione di questo secondo risultato si basa sulla monotonia della funzione (E(x)) che abbiamo trovato prima e su argomenti “soft” che includono un teorema di “riempimento dei gap” (gap filling theorem). In sostanza, si studia come gli autovalori isolati di una versione modificata dell’operatore possano “riempire” o meno i gap dello spettro essenziale quando si varia un parametro.

Perché è Importante?

Vi chiederete: “Ok, bello, ma a cosa serve tutto ciò?”. Beh, questi risultati hanno implicazioni profonde. Dal punto di vista della fisica della materia condensata, la localizzazione di Anderson è il meccanismo alla base della transizione metallo-isolante in certi materiali disordinati: se gli elettroni sono localizzati, non possono condurre corrente. Capire la struttura fine dello spettro, inclusi i gap, è cruciale per prevedere le proprietà elettroniche e di trasporto.

Dal punto di vista matematico, è una sfida affascinante che spinge i limiti delle tecniche di analisi funzionale e teoria perturbativa. Il fatto che metodi ispirati alla teoria KAM, nata in contesti di meccanica celeste, trovino applicazione qui, mostra la profonda unità della matematica.

Il nostro lavoro fornisce una prova perturbativa diretta della localizzazione per una classe ampia di potenziali monotoni, anche in presenza di discontinuità che avevano creato difficoltà a metodi precedenti. L’approccio è “veramente perturbativo” nel senso che costruiamo una base di autofunzioni che è una piccola perturbazione della base standard.

Spero che questo piccolo viaggio nel mondo degli operatori quasiperiodici vi abbia incuriosito. È un campo di ricerca attivo, dove ogni nuova scoperta apre la porta a ulteriori domande e misteri. Chissà quali altre sorprese ci riserva la matematica nascosta in queste strutture quasi ordinate!

Fonte: Springer