Sondino Nasogastrico e AI: La Rivoluzione Deep Learning nelle Radiografie!

Ciao a tutti! Oggi voglio parlarvi di qualcosa che mi appassiona tantissimo: come l’intelligenza artificiale, e in particolare il deep learning, sta cambiando in meglio il mondo della medicina. Nello specifico, ci tufferemo in un ambito molto delicato: il posizionamento del sondino nasogastrico (NGT).

Un Piccolo Tubo, Una Grande Responsabilità

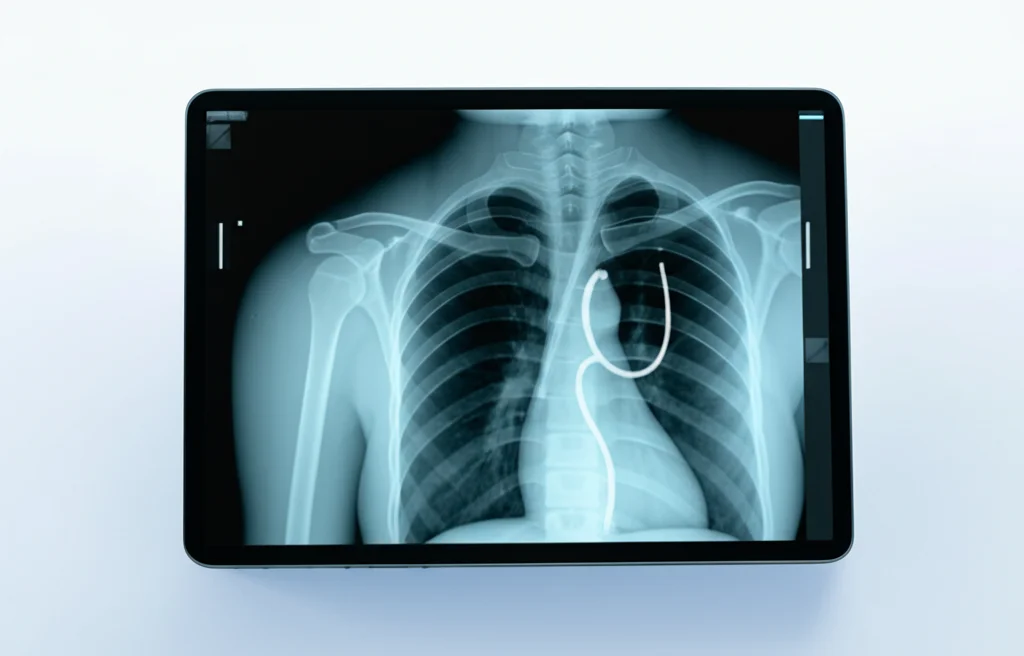

Forse non tutti sanno cos’è un sondino nasogastrico, ma è uno strumento medico fondamentale. Si tratta di un tubicino flessibile che viene inserito attraverso il naso, passa per l’esofago e arriva fino allo stomaco. A cosa serve? Beh, principalmente per nutrire i pazienti che non possono mangiare normalmente o per somministrare farmaci direttamente nello stomaco. Sembra semplice, vero? Eppure, il suo corretto posizionamento è assolutamente cruciale.

Se il sondino finisce nel posto sbagliato, ad esempio nelle vie respiratorie invece che nello stomaco, le conseguenze possono essere davvero gravi, mettendo a rischio la sicurezza del paziente. Tradizionalmente, dopo l’inserimento, si fa una radiografia del torace per controllare che tutto sia a posto. Ma qui sorge un problema: l’interpretazione di queste radiografie dipende dall’occhio umano, e sappiamo bene che l’errore umano è sempre dietro l’angolo, anche per i professionisti più esperti. C’è bisogno di un aiuto in più, di una soluzione innovativa.

L’Intelligenza Artificiale Scende in Campo

Ed è qui che entriamo in gioco noi, o meglio, entra in gioco il deep learning! Negli ultimi anni, queste tecnologie hanno fatto passi da gigante nell’analisi di dati complessi, superando spesso i metodi tradizionali in campi come il riconoscimento visivo. Era naturale pensare: perché non applicarle anche in ambito sanitario, per esempio per aiutarci con i sondini nasogastrici?

Alcuni studi precedenti avevano già provato a usare modelli di deep learning per individuare automaticamente i sondini posizionati male nelle radiografie. Hanno usato architetture come DenseNet, Inception-v3, EfficientNet… nomi forse un po’ tecnici, ma che rappresentano modelli AI molto potenti. Tuttavia, questi primi tentativi si concentravano principalmente sulla classificazione: il modello diceva “sì, è posizionato male” o “no, è posizionato bene”. Utile, certo, ma con un limite: non spiegavano dove fosse esattamente il problema o non visualizzavano chiaramente la posizione del sondino. Per un medico, capire se il posizionamento è “completo” (e quindi sicuro) o “incompleto” (rischioso) richiede un’analisi più dettagliata.

Il Nostro Approccio Rivoluzionario: Un Modello a Doppio Stadio

Per superare questi limiti, abbiamo sviluppato un approccio più completo, un modello deep learning a doppio stadio. L’idea è quella di imitare, in un certo senso, il processo che segue un medico: prima individua il sondino nell’immagine radiografica, poi analizza la sua posizione e le strutture circostanti per capire se è tutto ok.

Il nostro modello fa proprio questo, ma in modo automatico e super preciso, grazie a due fasi principali:

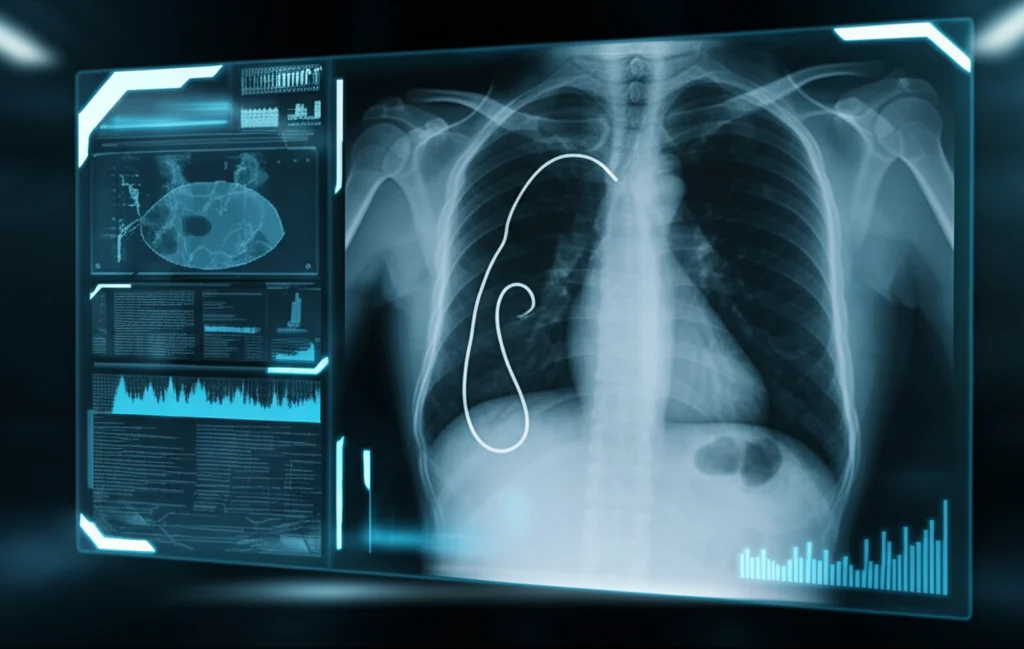

- Segmentazione: Nella prima fase, usiamo un modello specializzato (basato sulla famosa architettura nnU-Net) per “disegnare” con precisione il contorno del sondino nasogastrico e identificarne la punta direttamente sull’immagine radiografica. È come se l’AI evidenziasse il tubo per noi.

- Classificazione: Nella seconda fase, prendiamo l’immagine originale e ci “attacchiamo” sopra la mappa del sondino generata nella fase precedente. Questo input combinato, molto più ricco di informazioni, viene dato in pasto a un secondo modello (un ResNet50 pre-allenato con MedCLIP, un’altra chicca tecnologica specifica per immagini mediche) che ha il compito di classificare il posizionamento come “completo” (corretto e sicuro) o “incompleto” (errato o rischioso).

Questo approccio a due stadi non solo ci dice se il posizionamento è giusto o sbagliato, ma ci fornisce anche una mappa visiva del sondino, rendendo la valutazione molto più intuitiva e spiegabile per il personale sanitario, anche per chi non ha una specifica esperienza radiologica.

Allenare l’Occhio Elettronico: Dati e Risultati

Per “insegnare” al nostro modello a fare tutto questo, abbiamo raccolto un bel po’ di dati: ben 2.627 immagini radiografiche anonimizzate provenienti da tre diversi ospedali. Un team di esperti medici (specialisti in medicina respiratoria e radiologia con anni di esperienza) ha meticolosamente etichettato ogni immagine, indicando se il posizionamento del sondino era “completo” o “incompleto”. Questo lavoro di preparazione dei dati è fondamentale per garantire che l’AI impari correttamente.

Abbiamo usato circa 1800 immagini per l’allenamento e la validazione interna, e quasi 400 per un test esterno su dati completamente nuovi (provenienti da un ospedale diverso da quelli usati per l’allenamento), per verificare quanto il modello fosse robusto e generalizzabile.

E i risultati? Sono stati davvero entusiasmanti! Nella fase di segmentazione, abbiamo ottenuto un Dice Similarity Coefficient (una misura di quanto la “mappa” disegnata dall’AI sia simile a quella reale) del 65.35%. Ma è nella classificazione che il modello ha brillato: abbiamo raggiunto un’Area Under the Curve (AUC) del 99.72%! Per darvi un’idea, un AUC vicino al 100% significa che il modello è estremamente bravo a distinguere tra posizionamenti corretti e scorretti. Anche nei test esterni, i risultati sono rimasti molto alti (AUC del 92.27%), confermando la validità del nostro approccio. Questi numeri superano le performance dei metodi tradizionali e di molti approcci AI precedenti.

Guardare Dentro la “Mente” dell’AI: Grad-CAM

Una delle cose più affascinanti (e importanti) quando si lavora con l’AI è capire come prende le sue decisioni. Non vogliamo una “scatola nera” che ci dà una risposta senza spiegazioni. Per questo, abbiamo usato una tecnica chiamata Grad-CAM (Gradient-weighted Class Activation Mapping). In pratica, Grad-CAM ci mostra quali aree dell’immagine radiografica il modello ha “guardato” con più attenzione per arrivare alla sua conclusione.

Abbiamo visto che, nei casi di posizionamento corretto, Grad-CAM evidenziava proprio le zone giuste, confermando che il modello stava ragionando nel modo corretto. Tuttavia, abbiamo anche notato delle aree di miglioramento: a volte, il modello faceva più fatica a identificare con precisione i tubi posizionati male, e in alcuni casi Grad-CAM evidenziava zone irrilevanti dell’immagine (come scritte o aree periferiche). Questo ci dice che, sebbene il modello sia molto accurato, c’è ancora lavoro da fare per renderlo ancora più affidabile e interpretabile.

Limiti e Prospettive Future: La Strada è Ancora Lunga (Ma Promettente!)

Come ogni ricerca scientifica seria, anche la nostra ha dei limiti. È importante riconoscerli per poter migliorare in futuro.

- Segmentazione della punta: La precisione nel localizzare l’esatta punta del sondino non è ancora ottimale, forse a causa di una definizione iniziale un po’ ambigua. Dovremo affinare le annotazioni.

- Interpretabilità: Come accennato, Grad-CAM è utile ma non perfetto. Esploreremo altre tecniche per capire ancora meglio le decisioni dell’AI.

- Diversità delle apparecchiature: Le macchine per le radiografie non sono tutte uguali. Le differenze tra ospedali possono influenzare le performance del modello. Stiamo studiando tecniche di “adattamento” per renderlo più robusto a queste variazioni.

- Sbilanciamento dei dati: Fortunatamente, i casi di posizionamento errato sono meno comuni di quelli corretti (nel nostro dataset il rapporto era circa 1 a 7). Questo sbilanciamento può rendere più difficile per l’AI imparare a riconoscere bene i casi rari. Servono strategie specifiche per gestire questo aspetto.

- Esplorare nuovi modelli: Il mondo dell’AI è in continua evoluzione. Valuteremo l’uso di modelli di segmentazione ancora più recenti o approcci ibridi.

- Estendere l’applicazione: Il nostro approccio potrebbe funzionare anche per altri tipi di tubi e cateteri visibili nelle radiografie. Sarà interessante esplorare questa possibilità.

Un Prototipo Già Disponibile

Per dimostrare la fattibilità clinica della nostra ricerca, abbiamo sviluppato un prototipo funzionante accessibile online (all’indirizzo https://ngtube.ziovision.ai). Questo strumento permette di caricare una radiografia e ottenere l’analisi del posizionamento del sondino in tempo reale. È un passo concreto verso l’integrazione di questa tecnologia negli ospedali, con l’obiettivo di migliorare l’accuratezza, ridurre i tempi di interpretazione e rendere più efficiente il flusso di lavoro clinico.

Conclusione: Un Futuro Più Sicuro Grazie all’AI

In conclusione, il nostro modello deep learning a doppio stadio rappresenta un passo avanti significativo per migliorare l’accuratezza e la sicurezza nel posizionamento dei sondini nasogastrici. Combinando segmentazione e classificazione, offriamo uno strumento potente che può davvero aiutare i professionisti sanitari nel loro lavoro quotidiano, a tutto vantaggio della cura del paziente.

La strada della ricerca è ancora lunga, ma siamo convinti che l’intelligenza artificiale abbia un potenziale enorme per rivoluzionare la medicina. Continueremo a lavorare per affinare i nostri modelli, esplorare nuove tecnologie (come i Vision Transformer) e ampliare i nostri dataset, con l’obiettivo finale di rendere l’assistenza sanitaria sempre più precisa, efficiente e sicura per tutti.

Fonte: Springer