Machine Learning e Fotovoltaico: Chi Prevede Meglio Temperatura e Umidità?

Ciao a tutti! Oggi voglio parlarvi di qualcosa che mi appassiona molto: come possiamo usare l’intelligenza artificiale, o meglio il Machine Learning (ML), per rendere i nostri impianti fotovoltaici ancora più efficienti. Sapete, i pannelli solari sono fantastici, trasformano la luce del sole in energia pulita, un passo enorme verso un futuro più sostenibile. Ma c’è un “ma”: la loro performance non è costante, dipende molto da fattori ambientali come la temperatura e l’umidità.

Perché Temperatura e Umidità Sono Così Importanti?

Ve lo spiego subito. Immaginate un pannello solare al lavoro. Se fa troppo caldo, la sua efficienza cala. L’aumento della temperatura interna aumenta la resistenza e… puff, meno energia prodotta. E l’umidità? Beh, può portare a condensa, corrosione, e a lungo andare può danneggiare i materiali dei pannelli. Capite bene che prevedere con precisione questi due parametri diventa cruciale. Se sappiamo in anticipo che tempo farà, possiamo ottimizzare il funzionamento dell’impianto, pianificare la manutenzione al momento giusto e persino allungare la vita dei nostri pannelli. È qui che entra in gioco il Machine Learning.

La Sfida della Previsione

Prevedere temperatura e umidità in un ambiente fotovoltaico non è una passeggiata. Queste variabili sono influenzate da un sacco di fattori: la posizione geografica, le stagioni, le condizioni meteo locali. E spesso variano insieme, rendendo il tutto ancora più complesso. I modelli di ML sono perfetti per questo compito perché possono analizzare enormi quantità di dati, scovare pattern nascosti e capire le relazioni complesse tra le variabili, anche quelle non lineari, senza che noi dobbiamo dirgli esattamente cosa cercare. Ma quale modello di ML è il migliore per questo specifico lavoro? Bella domanda! La letteratura scientifica era un po’ carente su un confronto diretto e completo proprio per questo scenario.

La Nostra Indagine: Mettiamo alla Prova i Modelli ML

Ed è qui che mi sono tuffato in un’analisi comparativa. Ho preso ben nove diversi modelli di Machine Learning e li ho messi alla prova. L’obiettivo? Capire quale fosse il più bravo a prevedere temperatura e umidità per gli impianti fotovoltaici. I contendenti erano:

- Support Vector Regression (SVR)

- Lasso Regression

- Ridge Regression (RR)

- Linear Regression (LR) – il classico dei classici

- AdaBoost

- Gradient Boosting (GB)

- Decision Tree (DT) – l’albero delle decisioni

- Random Forest (RF) – una foresta di alberi decisionali

- eXtreme Gradient Boosting (XGBoost) – il “campione” potenziato

Ho usato un dataset bello corposo, con 5000 campioni di dati reali (temperatura, umidità, indice UV, voltaggio, corrente, illuminanza). L’80% dei dati l’ho usato per “allenare” i modelli, insegnandogli a riconoscere i pattern. Il restante 20% l’ho tenuto da parte per il test finale, per vedere come se la cavavano con dati mai visti prima. Questo è fondamentale per evitare che i modelli imparino a memoria i dati di training (overfitting) e per assicurarci che siano capaci di generalizzare.

Come Abbiamo Misurato il Successo?

Per capire chi fosse il migliore, ho usato tre metriche standard, ma molto efficaci:

- Mean Absolute Error (MAE): Misura l’errore medio assoluto. In pratica, ci dice mediamente di quanto si sbaglia il modello, senza considerare se la previsione è troppo alta o troppo bassa. Più basso è, meglio è.

- Root Mean Squared Error (RMSE): Simile al MAE, ma penalizza di più gli errori grandi perché eleva al quadrato le differenze prima di fare la media. Anche qui, più basso è il valore, migliore è la previsione.

- Coefficient of Determination (R²): Questo è un po’ diverso. Ci dice quanta parte della variabilità dei dati reali il modello riesce a spiegare. Va da 0 a 1. Un valore vicino a 1 significa che il modello “fitta” molto bene i dati. Più alto è, meglio è.

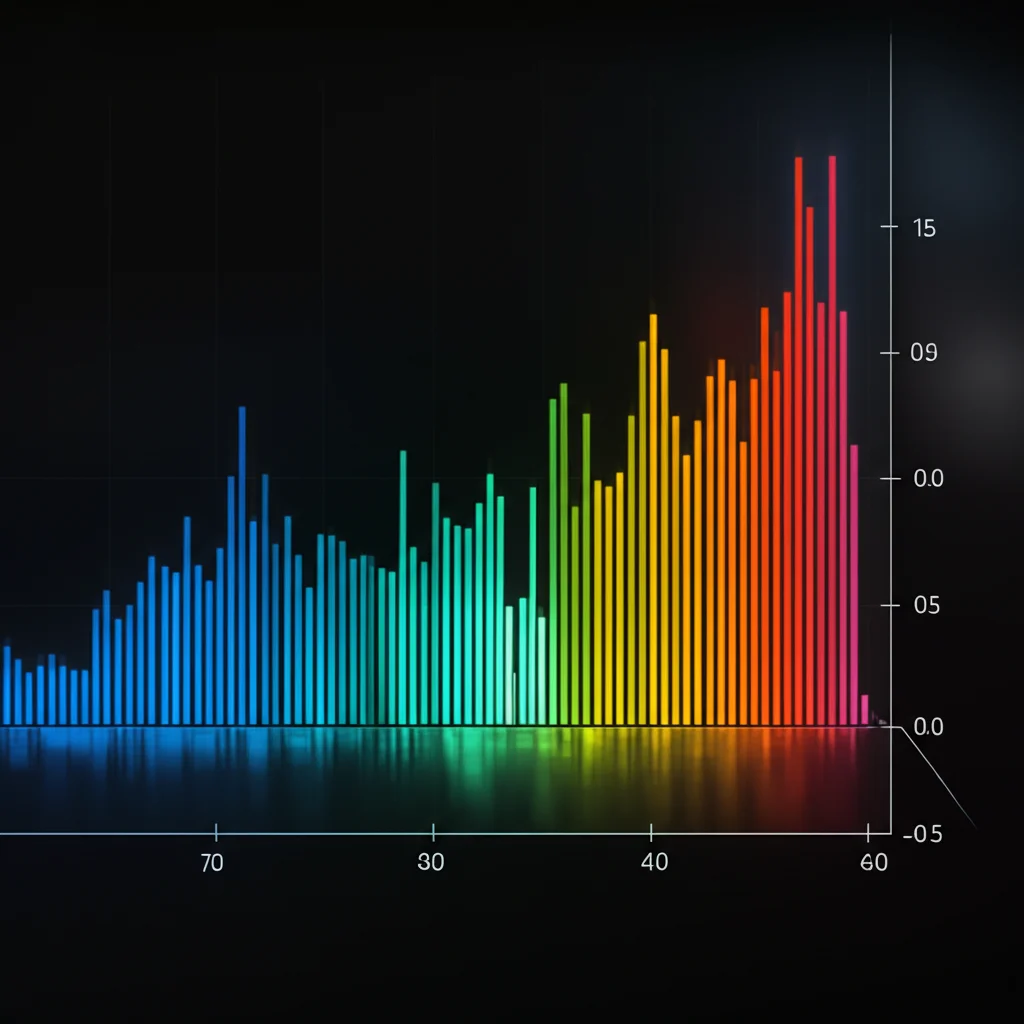

I Risultati: Chi Ha Vinto la Sfida della Temperatura?

E ora, i risultati! Per la previsione della temperatura, il vincitore indiscusso è stato XGBoost. Ha ottenuto il MAE più basso (1.544), l’RMSE più basso (1.242) e l’R² più alto (ben 0.947!). Questo significa che è stato incredibilmente accurato e affidabile. Anche Random Forest (RF) se l’è cavata egregiamente, piazzandosi subito dietro. Chi è andato peggio? Il povero SVR, con un MAE di 4.558 e un R² di solo 0.674. I modelli lineari come LR, Ridge e Lasso si sono piazzati a metà classifica. Questo ci dice una cosa importante: i modelli “ensemble” (quelli che combinano tanti modelli più semplici, come RF e XGBoost) sembrano gestire molto meglio la complessità delle interazioni ambientali rispetto ai modelli lineari più semplici.

E per l’Umidità?

La storia si ripete anche per la previsione dell’umidità. Ancora una volta, XGBoost ha sbaragliato la concorrenza con i valori migliori: MAE di 3.550, RMSE di 1.884 e R² di 0.744. Random Forest è stato di nuovo un ottimo secondo, confermando la forza degli approcci ensemble. E chi è arrivato ultimo? Esatto, ancora SVR, con un R² bassissimo di 0.253, dimostrando di faticare parecchio a prevedere l’umidità in questo contesto. Gli altri modelli si sono posizionati in modo simile a quanto visto per la temperatura.

Perché XGBoost e RF Sono Così Forti? E Cos’è SHAP?

Vi chiederete perché questi modelli ensemble funzionano così bene. In sostanza, combinano le previsioni di molti “apprendisti deboli” (spesso alberi decisionali semplici) in un modo intelligente. Questo permette loro di catturare relazioni non lineari e interazioni complesse tra le variabili che sfuggirebbero ai modelli più semplici. Sono più complessi, certo, e richiedono più potenza di calcolo, ma i risultati parlano chiaro.

Per capire ancora meglio *perché* XGBoost faceva certe previsioni, ho usato una tecnica chiamata SHAP (Shapley Additive Explanations). È un metodo fantastico che ci permette di “aprire la scatola nera” del modello e vedere quanto ogni singola variabile di input (come l’indice UV, il voltaggio, l’illuminanza) ha contribuito alla previsione finale. Per la temperatura, SHAP ha mostrato che l’indice UV e il voltaggio erano particolarmente influenti. Per l’umidità, invece, i fattori chiave sembravano essere il voltaggio e l’illuminanza. Questo tipo di analisi è preziosissimo perché non solo ci dice *quale* modello è migliore, ma anche *perché*, aumentando la fiducia e la trasparenza.

Limiti e Prossimi Passi

Ovviamente, ogni studio ha i suoi limiti. In questo caso, non abbiamo usato tecniche specifiche per filtrare il “rumore” nei dati prima di allenare i modelli. Modelli come RF e XGBoost sono abbastanza robusti al rumore, ma i modelli più semplici potrebbero averne sofferto. Sarebbe interessante, in futuro, vedere se pre-processare i dati con tecniche come la Trasformata Wavelet possa migliorare ulteriormente le previsioni.

E il futuro? Le strade sono tante! Si potrebbero esplorare modelli ancora più avanzati come le reti neurali profonde (Deep Learning), ottimizzare i parametri dei modelli con algoritmi specifici, integrare più dati ambientali (come velocità del vento o radiazione solare), e persino sviluppare sistemi che facciano queste previsioni in tempo reale, magari direttamente sull’impianto (edge computing) o nel cloud. L’obiettivo finale è creare sistemi di previsione sempre più intelligenti, affidabili e utili per massimizzare la produzione di energia pulita.

In Conclusione

Questa analisi comparativa ha messo in luce un aspetto fondamentale: quando si tratta di prevedere temperatura e umidità per ottimizzare gli impianti fotovoltaici, i modelli di Machine Learning ensemble, e XGBoost in particolare, sono una spanna sopra gli altri. Riescono a gestire la complessità dei dati ambientali reali molto meglio dei modelli lineari tradizionali o di SVR. Scegliere il modello giusto è quindi cruciale per ottenere previsioni accurate.

Usare algoritmi potenti come XGBoost ci permette di monitorare meglio l’ambiente in cui operano i nostri pannelli, ottimizzarne le prestazioni e la manutenzione, e in definitiva, rendere l’energia solare ancora più efficiente e affidabile. È un campo in continua evoluzione, e sono convinto che il Machine Learning giocherà un ruolo sempre più centrale nel futuro delle energie rinnovabili. Continuiamo a esplorare e innovare per un futuro più sostenibile e data-driven!

Fonte: Springer