Svelando i Segreti della Normale Piegata Multivariata: Funzione Caratteristica e Oltre!

Amici appassionati di statistica e dintorni, preparatevi per un viaggio affascinante nel cuore di una distribuzione di probabilità tanto particolare quanto utile: la distribuzione normale piegata multivariata. Lo so, il nome potrebbe suonare un po’ ostico, ma vi assicuro che il concetto è più intuitivo di quanto sembri e le sue implicazioni sono davvero notevoli in un sacco di campi!

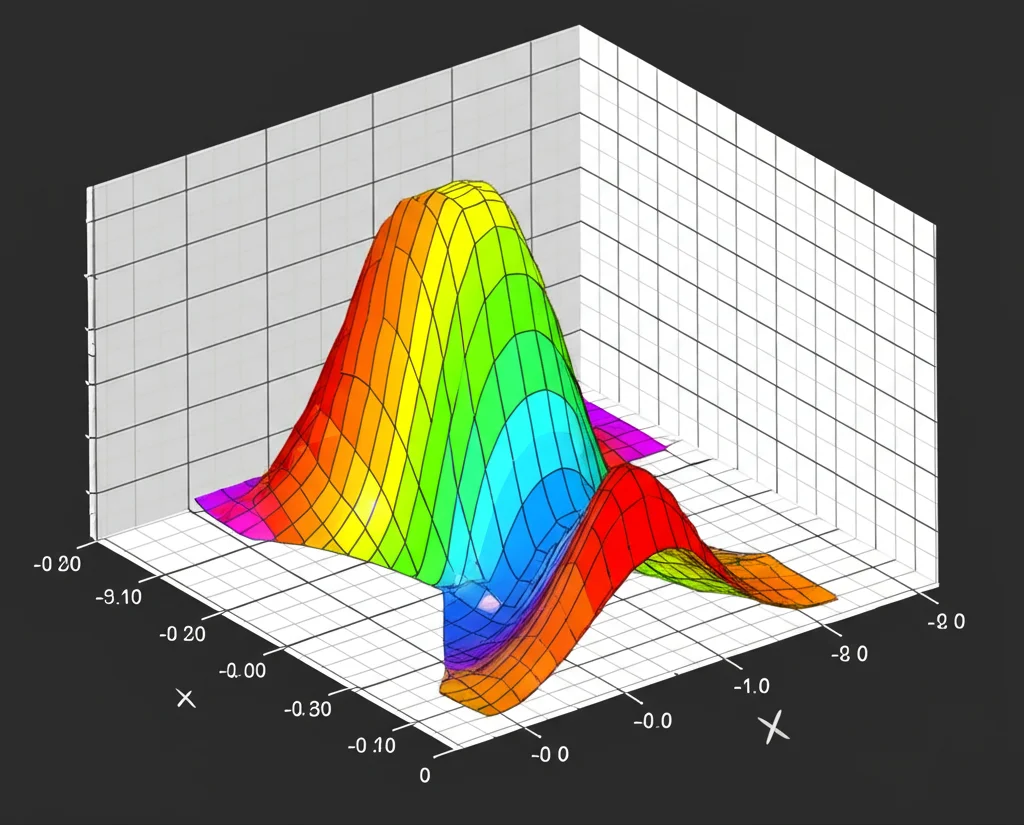

Immaginate di avere a che fare con dei dati che seguono una distribuzione normale (la classica curva a campana, per intenderci), ma per qualche motivo siete interessati solo alla loro grandezza, al loro valore assoluto, e non al segno (positivo o negativo). Ecco, “piegando” la parte negativa della distribuzione sulla parte positiva, otteniamo la nostra protagonista. Questo studio si concentra su un aspetto cruciale: derivare la sua funzione caratteristica. E perché mai dovremmo imbarcarci in questa impresa, vi chiederete? Beh, continuate a leggere e lo scopriremo insieme!

Cos’è questa “bestia”? La Distribuzione Normale Piegata Multivariata

Partiamo dalle basi. La distribuzione normale, come saprete, è una superstar nel mondo della statistica. Descrive una miriade di fenomeni naturali e non. La versione “piegata” (folded normal distribution in inglese) entra in gioco quando, di una variabile casuale normale con una certa media (mu) e varianza (sigma^2), osserviamo solo il suo valore assoluto, diciamo (W = |X|). Tutta la massa di probabilità che si trovava a sinistra dello zero viene, appunto, “ripiegata” sulla destra.

Ora, pensate a questo concetto esteso a più dimensioni. Se abbiamo un vettore di variabili casuali che seguono una distribuzione normale multivariata (cioè, più variabili normali che possono essere correlate tra loro), e prendiamo il valore assoluto di ciascuna componente, otteniamo la distribuzione normale piegata multivariata. Manteniamo la dipendenza tra le componenti, ma ci concentriamo sulla loro magnitudine. Questa distribuzione è anche conosciuta come absolute normal distribution.

A cosa serve tutta questa fatica? Le Applicazioni Pratiche

Vi starete chiedendo: “Ok, interessante, ma a che serve?”. Le applicazioni sono sorprendentemente vaste e toccano settori molto diversi:

- Fisica: Pensate alla conduzione del calore. La distribuzione normale piegata univariata è una soluzione fondamentale dell’equazione del calore per valori positivi.

- Statistica Industriale: Controllo di qualità, stima della varianza tramite il range mobile medio nei diagrammi di controllo.

- Finanza: Qui si scatena! Per esempio, per esprimere il rischio di un portafoglio di investimenti usando i rendimenti assoluti, per descrivere la volatilità storica dei prezzi, o per valutare il turnover generato dal ribilanciamento dei pesi degli asset in un portafoglio.

- Ingegneria: Ovunque ci siano segnali o misurazioni di cui interessa la magnitudine e non la direzione.

- Medicina e Biometria: Per misurare l’asimmetria del corpo umano o la variabilità dei dati dei pazienti, come la pressione sanguigna.

Insomma, ogni volta che abbiamo a che fare con le grandezze assolute di fenomeni normalmente distribuiti e potenzialmente correlati, questa distribuzione può darci una grossa mano.

Il Cuore della Ricerca: Funzione Caratteristica e Generatrice dei Momenti

Il contributo principale di questo studio, e qui entriamo nel vivo, è la derivazione analitica della funzione caratteristica (cf) della distribuzione normale piegata multivariata. E, strettamente legata ad essa, la funzione generatrice dei momenti (mgf). Perché sono così importanti?

La funzione caratteristica è una sorta di “carta d’identità” di una distribuzione di probabilità. Conoscerla ci permette di:

- Capire a fondo le proprietà fondamentali della distribuzione.

- Facilitare valutazioni numeriche di distribuzioni complesse, specialmente quelle che coinvolgono combinazioni lineari di valori assoluti di variabili normali dipendenti. Immaginate di voler conoscere la distribuzione della somma dei valori assoluti delle componenti di un vettore normale multivariato: la funzione caratteristica è la chiave!

- Derivare momenti della distribuzione (come media, varianza, covarianza, ecc.).

La derivazione presentata nel paper si basa su una nuova espressione della funzione generatrice dei momenti, formulata utilizzando la funzione di distribuzione cumulativa della normale multivariata. È importante sottolineare che lavori precedenti avevano tentato di derivare la mgf, la media e la matrice di covarianza, ma, come evidenziato da Murthy (2015) per il caso bivariato, alcuni risultati erano incorretti. Questo studio si preoccupa di fornire espressioni corrette e verificate.

Un dettaglio tecnico, ma fondamentale: la funzione caratteristica (operatorname{cf}_X(t)) si ottiene dalla funzione generatrice dei momenti (operatorname{mgf}_X(t)) semplicemente valutando quest’ultima in (textrm{i}t), dove (textrm{i}) è l’unità immaginaria. Sembra facile, ma arrivarci è stato un bel percorso matematico!

Per chi ama i dettagli, la funzione generatrice dei momenti di (varvec{W}= |varvec{X}|), dove (varvec{X} sim textsf{N}_n(varvec{mu }, varvec{Sigma })), assume una forma che coinvolge una somma di (2^n) termini, ognuno dei quali include esponenziali e la funzione di distribuzione cumulativa della normale standard multivariata, valutata in argomenti che dipendono dai parametri della distribuzione originale e dal vettore (varvec{t}) della trasformata. La complessità cresce esponenzialmente con la dimensione (n), ma la struttura è ben definita.

La derivazione dell’integrale (I) che compare nell’espressione della mgf è particolarmente ingegnosa e fa uso della scomposizione di Cholesky della matrice di varianza-covarianza e di sostituzioni intelligenti. Per rendere il tutto più digeribile, il paper presenta i casi specifici per (n=1, 2, 3) dimensioni, guidando il lettore attraverso i passaggi. Ad esempio, per il caso univariato, il risultato coincide con quelli già noti in letteratura, il che è sempre un buon segno!

Mettere i Numeri alla Prova: Esempi e Implementazioni

La teoria è bella, ma la pratica lo è ancora di più! Per validare i risultati, i ricercatori hanno presentato due esempi utilizzando un’implementazione in MATLAB. Hanno confrontato la funzione caratteristica per la somma dei valori assoluti degli elementi di un vettore normale multivariato con la sua controparte empirica simulata. I grafici mostrano una corrispondenza eccellente, il che ci dà grande fiducia nella correttezza delle formule derivate.

Inoltre, hanno derivato il secondo momento misto della distribuzione normale piegata bivariata a partire dalla funzione generatrice dei momenti, dimostrando che coincide con le espressioni teoriche note (ad esempio, quelle di Murthy). Questo tipo di “controllo incrociato” è fondamentale nella ricerca scientifica.

Un aspetto cruciale per il calcolo della funzione caratteristica è la valutazione della funzione di distribuzione cumulativa della normale multivariata in argomenti complessi. Per il caso univariato, si usa la funzione di Faddeeva. Per dimensioni superiori (n>2), si possono adattare i metodi proposti da Genz, che scompongono la probabilità in una probabilità di riferimento e una correzione data da un integrale monodimensionale. Anche qui, la sfida computazionale non è banale, ma gestibile con gli strumenti giusti.

È stato anche analizzato il caso specifico della funzione caratteristica della somma (Z = sum |X_i|). Anche se ci si potrebbe aspettare semplificazioni significative per strutture particolari della matrice di varianza-covarianza (ad esempio, matrici diagonali o con equicorrelazione), le espressioni rimangono piuttosto complesse, ma gestibili numericamente.

Sfide e Orizzonti Futuri

Non nascondiamocelo: i calcoli possono diventare impegnativi, specialmente per dimensioni elevate e matrici di varianza-covarianza non diagonali. La valutazione della funzione caratteristica, soprattutto per valori elevati dell’argomento, può presentare instabilità numeriche dovute agli errori di integrazione numerica nel calcolo della cdf della normale multivariata. Questo è un aspetto su cui si concentreranno i lavori futuri.

Un contributo notevole del paper è anche la generalizzazione degli integrali normali di Owen, essenziali per la valutazione della funzione caratteristica. Questi integrali generalizzati permettono un calcolo più efficiente di integrali multidimensionali, cruciali quando ci sono dipendenze tra le componenti.

Nonostante le sfide computazionali, avere espressioni analitiche esatte è un passo avanti enorme. Forniscono una base teorica solida che può essere ulteriormente sviluppata. Il lavoro futuro potrebbe concentrarsi sul miglioramento dell’efficienza computazionale e sull’esplorazione di tecniche di approssimazione per matrici con strutture quasi diagonali, cercando un equilibrio tra accuratezza e fattibilità computazionale.

In conclusione, questo studio ci ha fornito strumenti analitici preziosi per comprendere e lavorare con la distribuzione normale piegata multivariata. Le espressioni derivate per la funzione generatrice dei momenti e, soprattutto, per la funzione caratteristica, aprono nuove strade per la modellazione e l’analisi in tutti quei campi – dalla finanza all’ingegneria, dalla statistica industriale all’analisi di dati sanitari – dove la comprensione delle dipendenze e della variabilità delle grandezze assolute è critica. Un tassello importante nel grande puzzle della statistica multivariata!

Fonte: Springer