Trasformatori Intelligenti: Il Mio Segreto AI per Scovare Guasti Invisibili!

Ciao a tutti! Oggi voglio parlarvi di qualcosa che mi appassiona tantissimo e che sta rivoluzionando il modo in cui gestiamo l’energia: la diagnosi dei guasti nei trasformatori elettrici, ma fatta in modo smart, anzi, super smart! Immaginate i trasformatori come il cuore pulsante delle nostre reti elettriche, le famose smart grid. Sono fondamentali per portare l’elettricità fino alle nostre case e alle nostre aziende. Ma cosa succede se uno di questi giganti si ammala?

L’Importanza dei Trasformatori e la Sfida della Diagnosi

Un guasto a un trasformatore non è uno scherzo. Può causare blackout, interruzioni costose per le industrie (parliamo di costi chiamati CIC, Customer Interruption Costs) e, in generale, un bel po’ di problemi. Pensate che le statistiche (quelle serie, tipo CIGRE e IEEE) dicono che i problemi agli avvolgimenti sono tra i più comuni. Questi avvolgimenti, stressati da calore, sollecitazioni meccaniche ed elettriche, possono andare in corto circuito. Anche un piccolo corto circuito tra spire vicine (inter-turn fault), magari all’inizio non catastrofico, può indebolire il trasformatore e preparare il terreno per guai ben peggiori. Ecco perché beccare questi problemi sul nascere è cruciale. Dobbiamo monitorare la salute dei trasformatori continuamente, quasi come faremmo con un paziente importante!

Vecchi Metodi vs. Nuove Frontiere: La Termografia e l’AI

Tradizionalmente, per controllare un trasformatore bisognava spegnerlo (offline). Immaginate il disagio e la perdita di energia! Per fortuna, esistono tecniche online, che permettono di fare controlli senza interrompere il servizio. Tra queste, una delle mie preferite è la termografia. Avete presente quelle telecamere che vedono il calore? Esatto! Usando camere a infrarossi (IR), possiamo “fotografare” la distribuzione del calore sul trasformatore. Un componente che si sta guastando, infatti, tende a scaldarsi di più. Analizzando queste immagini termiche, possiamo individuare punti caldi sospetti e capire se c’è qualcosa che non va, e persino quanto è grave. È una tecnica non invasiva (non dobbiamo toccare nulla!) e ci permette un monitoraggio continuo. Certo, le termocamere buone costano, ma pensate al risparmio evitando guasti gravi! Ma come analizzare queste immagini in modo efficiente? Qui entra in gioco l’Intelligenza Artificiale (AI), e in particolare il Deep Learning (DL). Il DL è fantastico perché, a differenza dei metodi tradizionali di Machine Learning (ML) dove dovevi “spiegare” tu alla macchina cosa cercare, le reti neurali profonde imparano da sole a riconoscere pattern complessi direttamente dai dati, come le immagini termiche. Le Reti Neurali Convoluzionali (CNN) sono particolarmente brave in questo, quasi come se avessero degli “occhi” per analizzare le immagini.

Però, anche il DL ha le sue sfide: servono tanti dati (e i guasti, per fortuna, non sono così comuni, quindi i dati scarseggiano), c’è il rischio di “overfitting” (quando il modello impara troppo bene i dati di training e poi non generalizza bene su dati nuovi), e spesso richiede una potenza di calcolo notevole. Inoltre, molti approcci esistenti o usano metodi complessi di estrazione manuale delle caratteristiche (features), o usano reti DL enormi che estraggono migliaia di features, rendendo tutto lento e complicato. E se vi dicessi che abbiamo trovato un modo più furbo e leggero?

La Nostra Arma Segreta: Il Framework “Trans-Light”

Ed eccoci al cuore della questione! Abbiamo sviluppato un framework che abbiamo chiamato Trans-Light. L’idea era creare un sistema di diagnosi basato su DL e termografia che fosse leggero, veloce ed estremamente accurato. Come ci siamo riusciti? Combinando un po’ di assi nella manica:

- CNN Leggere + Transfer Learning: Invece di costruire da zero reti enormi, abbiamo usato modelli CNN già esistenti e noti per essere efficienti (MobileNet e ResNet-18) e li abbiamo adattati al nostro compito specifico usando il “Transfer Learning”. È come prendere un motore già rodato e ottimizzarlo per una nuova auto: si risparmia tempo e fatica!

- Features da Più Livelli: Una CNN impara cose diverse a diversi livelli di profondità. I primi strati vedono dettagli semplici (bordi, texture), quelli più profondi riconoscono pattern complessi specifici del guasto. Noi, furbescamente, abbiamo deciso di estrarre informazioni (features) da due livelli diversi della CNN (uno intermedio, di pooling, e uno finale, fully connected) per avere una visione più completa.

- Magia delle Wavelet (DTCWT): Le features estratte dalle CNN ci danno informazioni spaziali (dove si trova il calore). Ma per rendere l’analisi ancora più potente, abbiamo usato la Trasformata Wavelet Complessa Dual-Tree (DTCWT) sulle features del livello di pooling. Questa tecnica non solo ci dà informazioni nel dominio tempo-frequenza (come cambia il calore nel tempo e a quali “ritmi”), ma ha anche il fantastico pregio di ridurre la dimensionalità delle features estratte, rendendo tutto più snello!

- Unione e Selezione: Abbiamo unito le features “potenziate” con DTCWT dal livello di pooling con quelle del livello fully connected. Ma anche così, potevano esserci features ridondanti o poco utili. Quindi, abbiamo applicato un metodo di feature selection (abbiamo testato Chi-quadro χ² e ReliefF) per tenere solo le features davvero importanti, quelle che fanno la differenza per la diagnosi. Meno features = meno calcoli, meno tempo, modello più semplice e interpretabile!

- Niente Complicazioni Extra: Abbiamo evitato passaggi complessi come la segmentazione o il clustering delle immagini, mantenendo il sistema il più diretto possibile.

In pratica, abbiamo creato un flusso di lavoro in cinque fasi: preparazione dell’immagine (inclusa l’augmentation per avere più dati di training), implementazione del modello CNN leggero, estrazione delle features dai due livelli con l’aiuto di DTCWT, fusione e selezione delle features, e infine la diagnosi vera e propria usando classificatori ML standard (ne abbiamo testati sei: LDA, kNN, e varie versioni di SVM).

Mettiamolo alla Prova: Esperimenti e Risultati Sorprendenti

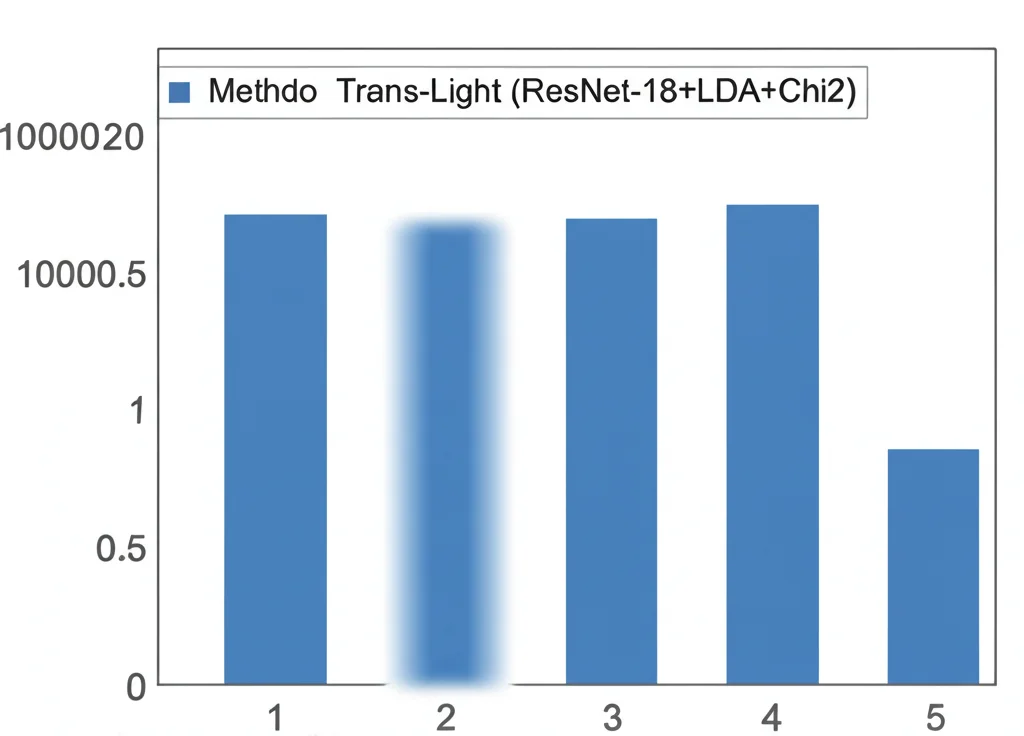

Ovviamente, non ci siamo fidati solo delle idee, abbiamo testato tutto rigorosamente! Abbiamo usato un dataset pubblico (creato da altri ricercatori, disponibile in letteratura) contenente immagini termiche di un trasformatore monofase in condizioni normali e con 8 diversi livelli di guasto di corto circuito tra spire. Abbiamo messo alla prova diverse combinazioni: due modelli CNN (MobileNet, ResNet-18), due metodi di feature selection (χ², ReliefF) e sei classificatori (LDA, kNN, LSVM, CSVM, QSVM, MSVM). E i risultati? Strepitosi! La combinazione vincente, in condizioni senza rumore aggiunto, è stata: ResNet-18 + selezione features con Chi-quadro (χ²) + classificatore LDA. Con questa configurazione, abbiamo raggiunto un’accuratezza del 100% usando solo 50 features! Avete capito bene: 100% di precisione con un numero ridicolmente basso di features. Confrontando con lavori precedenti sullo stesso dataset, che magari raggiungevano il 100% ma usando centinaia o migliaia di features, il nostro Trans-Light si è dimostrato incredibilmente più efficiente. Meno features significa meno complessità computazionale, training più veloce (parliamo di secondi invece che ore!) e un modello più facile da implementare anche su dispositivi con risorse limitate. Abbiamo calcolato anche altre metriche come precision, sensitivity, specificity e F1-score, e per la combinazione vincente erano tutte perfette (valore 1). Le matrici di confusione e le curve ROC/AUC confermavano: il sistema non sbagliava un colpo!

La Prova del Nove: Affrontare il Rumore del Mondo Reale

Ok, bello vincere facile senza rumore, ma nel mondo reale i dati non sono mai perfetti. Ci possono essere disturbi nei sensori, interferenze elettromagnetiche, fattori ambientali… Quindi, abbiamo messo alla prova la robustezza del nostro framework aggiungendo artificialmente due tipi di rumore alle immagini termiche: rumore Gaussiano e rumore Speckle. Come se l’è cavata Trans-Light? Ovviamente, l’accuratezza è un po’ scesa rispetto al 100% (sarebbe stato troppo bello!), ma il sistema ha dimostrato una notevole resilienza. Il rumore Gaussiano si è rivelato un po’ più fastidioso dello Speckle. Anche qui, combinare features da due livelli e fare feature selection ha aiutato a gestire meglio il rumore rispetto all’usare features da un solo livello. E indovinate quale combinazione si è comportata meglio nel complesso, offrendo il miglior compromesso tra accuratezza e numero minimo di features anche sotto rumore? Esatto: ancora ResNet-18 + LDA + selezione χ² con 50 features! Non ha raggiunto l’accuratezza più alta in assoluto sotto rumore (il classificatore QSVM è andato leggermente meglio in alcuni casi, ma richiedendo più features o essendo meno costante), ma si è classificata seconda mantenendo il vantaggio del numero minimo di features (raggiungendo comunque ottimi 87.1% con rumore Gaussiano e 87.5% con Speckle). Questo conferma la bontà della nostra scelta: un sistema che è il top in condizioni ideali e si difende egregiamente quando le cose si fanno difficili, rimanendo sempre leggero ed efficiente.

Perché Tutto Questo è Importante? Vantaggi e Complessità

Riassumendo, perché dovreste entusiasmarvi per Trans-Light come faccio io?

- Accuratezza Top: 100% in condizioni normali, ottima robustezza al rumore.

- Leggerezza Computazionale: Usa modelli CNN leggeri e pochissime features (solo 50!), riducendo drasticamente i tempi di training e classificazione.

- Efficienza Energetica: Essendo un metodo online e non invasivo, permette il monitoraggio continuo senza interrompere l’operatività del trasformatore, massimizzando il risparmio energetico.

- Diagnosi Precoce: Permette di individuare guasti incipienti prima che diventino gravi, pianificando la manutenzione in modo mirato.

- Semplicità: Evita passaggi complessi come la segmentazione, rendendo l’implementazione più facile.

- Interpretabilità: Usare poche features significative rende il modello più facile da capire e aiuta gli esperti a identificare i parametri critici.

Dal punto di vista della complessità, usare ResNet-18 (circa 11 milioni di parametri) e soprattutto MobileNet (circa 3.5 milioni) è già un passo avanti rispetto a modelli più pesanti. Ma il vero colpo da maestro è la fase di classificazione che opera su sole 50 features, rendendola estremamente veloce e adatta ad applicazioni real-time, anche in ambienti con risorse limitate.

Uno Sguardo al Futuro: Le Sfide che ci Aspettano

Il nostro lavoro si è concentrato su trasformatori di piccola/media taglia. Applicare queste tecniche a trasformatori di grande potenza, magari quelli a olio (dove l’olio può mascherare problemi interni) o quelli di tipo secco (che hanno pattern di calore diversi), presenta nuove sfide. Bisognerà forse integrare la termografia con altri dati (come l’analisi dei gas disciolti nell’olio – DGA), sviluppare tecniche di segmentazione più avanzate per isolare il trasformatore in immagini complesse, gestire dati da sensori multipli posizionati diversamente e, soprattutto, migliorare ulteriormente la robustezza al rumore ambientale, magari usando tecniche di pre-processing delle immagini più sofisticate o addestrando modelli DL intrinsecamente più tolleranti al rumore (come le Denoising CNN o usando l’ensemble learning). C’è ancora tanto da esplorare!

In Conclusione: Un Passo Avanti per le Smart Grid

Sono davvero convinto che approcci come Trans-Light rappresentino un passo avanti significativo per la manutenzione predittiva nelle smart grid. Garantire l’affidabilità dei trasformatori non solo evita disagi e costi, ma contribuisce anche agli obiettivi di sostenibilità, promuovendo un’energia più pulita, accessibile e un’industrializzazione sostenibile. Il nostro framework dimostra che è possibile combinare alta accuratezza, efficienza computazionale e robustezza, offrendo uno strumento potente per mantenere in salute il cuore delle nostre reti elettriche. E il bello è che siamo solo all’inizio!

Fonte: Springer