Il Segreto Nascosto nei Dati delle Caldaie: La Sfida della Coda Lunga

Ciao a tutti! Oggi voglio parlarvi di qualcosa che potrebbe sembrare puramente tecnico, ma che nasconde sfide affascinanti e ha un impatto enorme su settori chiave della nostra industria: le caldaie industriali e i dati che generano. Immaginatele come il cuore pulsante di centrali elettriche, industrie chimiche, metallurgiche e cartiere. Trasformano l’energia chimica del combustibile in calore, producendo il vapore essenziale per tantissimi processi.

Analizzare i dati che provengono da queste macchine complesse, le cosiddette serie temporali (dati raccolti nel tempo), è fondamentale. Ci permette di capire come interagiscono i vari parametri operativi (pressione, temperatura, flusso…), di ottimizzare le impostazioni e, cosa non da poco, di allungare la vita utile di questi costosi impianti.

Ma c’è un “ma”. Le caldaie lavorano in condizioni estreme: temperature e pressioni altissime, polvere ovunque. Questo, unito a possibili problemi nella trasmissione dei dati, fa sì che i sensori spesso registrino informazioni incomplete o errate. È qui che entriamo in gioco noi.

La nostra avventura: un dataset unico da una centrale chimica

Ci siamo concentrati sulla raccolta di dati operativi da una caldaia a carbone specifica, situata in un impianto chimico nello Zhejiang, in Cina. Abbiamo affrontato il problema dei dati “sporchi”, li abbiamo pre-processati e abbiamo creato un dataset di serie temporali ad alta dimensionalità. Questo dataset include parametri cruciali come pressione, temperatura, portata e livelli di ossigeno.

La cosa davvero interessante? Abbiamo usato la temperatura del vapore in uscita dalla caldaia come indicatore chiave dello stato dell’impianto. E analizzando questo parametro, abbiamo scoperto che il nostro dataset presenta una caratteristica particolare: una distribuzione a coda lunga (long-tailed distribution). Questo significa che la maggior parte dei dati rappresenta condizioni operative normali, mentre una piccola parte (la “coda”) rappresenta condizioni anomale o meno frequenti. Questo dataset diventa così una base preziosa per affrontare proprio il problema della “coda lunga” nell’analisi dei dati industriali.

Ma cos’è esattamente una caldaia e perché è così complessa?

Pensate a una caldaia come a un sistema sofisticato di trasformazione energetica. C’è una parte chiamata “forno” dove il combustibile (nel nostro caso, carbone) viene bruciato miscelandosi con aria. Il carbone viene frantumato, immesso nella camera di combustione, si mescola con materiale caldo e brucia rapidamente. L’aria ad alta velocità trasporta particelle solide, che vengono separate e reimesse in circolo per continuare la combustione. I gas di scarico caldi passano poi attraverso scambiatori di calore prima di essere espulsi.

Poi c’è la parte chiamata “pentola” (pot), il sistema del vapore. L’acqua di alimentazione viene preriscaldata, passa attraverso tubi dove viene riscaldata e vaporizzata, torna in un collettore dove vapore e acqua vengono separati. Il vapore viene ulteriormente surriscaldato e inviato all’utenza finale. È un processo dinamico, con tantissimi parametri che interagiscono tra loro, specialmente quando il carico di lavoro della caldaia varia.

Gli algoritmi tradizionali faticano a modellare accuratamente questi scenari reali. Ma qui entra in gioco l’intelligenza artificiale, in particolare il deep learning. Queste tecniche, basate sui dati, sono molto più efficaci nel modellare i complessi processi di combustione e analizzare le performance della caldaia.

Non dimentichiamo poi l’impatto ambientale: le emissioni (CO2, SO2, NO2, polveri) devono essere monitorate e controllate. Molti studi si sono concentrati su come ottimizzare la combustione per ridurre le emissioni e migliorare l’efficienza. E c’è anche il tema della sicurezza: un guasto non rilevato tempestivamente può portare a incidenti gravi. Per questo, sviluppare metodi efficaci di diagnosi dei guasti è cruciale.

La Sfida della Raccolta Dati: Un Ambiente Ostile

Come dicevo, raccogliere dati di qualità da una caldaia è difficile. L’ambiente è ostile (alte temperature, pressioni, polveri) e i sensori possono danneggiarsi facilmente. Inoltre, i guasti veri e propri sono eventi rari, difficili da “catturare” nei dati. Questo porta a uno squilibrio: tantissimi dati di funzionamento normale e pochissimi dati anomali. Ecco di nuovo la nostra distribuzione a coda lunga.

Per superare la mancanza di dataset pubblici di alta qualità con queste caratteristiche, abbiamo deciso di creare e condividere il nostro, raccolto in condizioni industriali reali tra il 27 marzo e il 1° aprile 2022. Abbiamo registrato 30 variabili ogni 5 secondi, per un totale di 86.400 campioni. La temperatura del vapore in uscita è il nostro parametro chiave: normalmente è tra 530°C e 545°C (i dati “di testa”). Valori fuori da questo range indicano condizioni anomale (i dati “di coda”), che nel nostro dataset costituiscono circa l’8.6% del totale.

Per monitorare tutto questo, abbiamo implementato una rete di sensori di alta precisione (temperatura, pressione, flusso) collegati a un Sistema di Controllo Distribuito (DCS). I segnali vengono trasmessi, condizionati per garantire accuratezza e affidabilità, e archiviati con timestamp. Infine, i dati vengono esportati in un formato strutturato, come un file CSV.

Pulire i Dati: Il Problema dei Valori Mancanti

A causa dell’ambiente difficile e delle interferenze elettromagnetiche, alcuni dati possono andare persi o risultare corrotti durante la trasmissione. Se un pacchetto dati è illeggibile, viene trattato come un valore mancante. I valori mancanti sono un problema per l’analisi delle serie temporali.

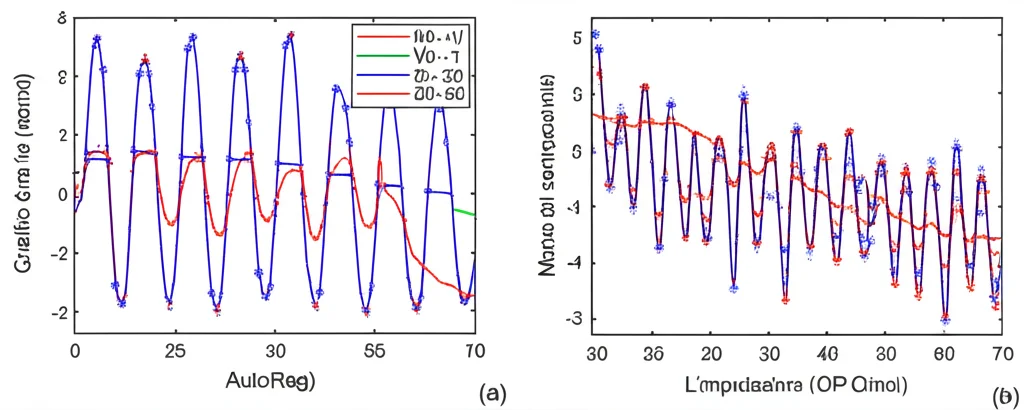

Metodi semplici come sostituire i valori mancanti con zero, con la media o con un’interpolazione lineare possono distorcere la distribuzione originale dei dati. Noi abbiamo scelto un approccio più sofisticato: il modello AutoReg. Abbiamo usato i 10.000 dati precedenti a un valore mancante per addestrare il modello a prevedere e “riempire” il buco. Abbiamo identificato e corretto valori mancanti, ad esempio, nel flusso d’acqua di desurriscaldamento primario. Abbiamo applicato questo metodo a tutto il dataset per assicurarci che fosse completo e affidabile. Mettiamo a disposizione sia la versione con i dati completati (xinan_completed_data.csv) sia quella con i valori mancanti ancora presenti (xinan_uncompleted_data.csv), così chi usa il dataset può scegliere come procedere.

Prevedere il Futuro (della Caldaia): I Modelli Transformer alla Prova

Una delle applicazioni più importanti di questi dati è la previsione della temperatura del vapore in uscita. Previsioni accurate sono vitali per la sicurezza e l’affidabilità. Abbiamo messo alla prova diverse varianti di un modello di deep learning molto potente per le serie temporali: il Transformer (Informer, Autoformer, Fedformer, PatchTST, Preformer, iTransformer, Pathformer).

Abbiamo addestrato questi modelli a prevedere la temperatura a diverse lunghezze future (96, 192, 336, 720 passi temporali, che corrispondono a diversi minuti/ore). Abbiamo valutato le prestazioni usando metriche come l’Errore Quadratico Medio (MSE) e l’Errore Assoluto Medio (MAE): più bassi sono, meglio è.

I risultati? Modelli diversi funzionano meglio a seconda della lunghezza della previsione (Fedformer per le brevi, Pathformer per le lunghe). Come prevedibile, le prestazioni peggiorano all’aumentare della lunghezza della previsione. Per migliorare la robustezza, abbiamo proposto una tecnica di integrazione ponderata dei modelli: diamo più “peso” ai modelli che hanno performato meglio per una certa lunghezza di previsione e calcoliamo una media ponderata. Questo approccio ha mostrato risultati promettenti, avvicinando le previsioni finali ai valori reali.

Generare Nuovi Dati: Possiamo Replicare la Realtà (Anche quella Rara)?

L’altra grande sfida posta dalla distribuzione a coda lunga è che i modelli di machine learning tradizionali tendono a “imparare” molto bene dai dati normali (la maggioranza) ma a ignorare o trattare male i dati anomali (la minoranza). Questo è un problema serio se vogliamo rilevare guasti o condizioni rare.

Tecniche comuni come il sovracampionamento (creare copie dei dati rari) o il sottocampionamento (eliminare dati comuni) possono introdurre altri problemi. Un approccio più moderno è usare modelli generativi, come Diffusion-TS, TimeVAE e TimeGAN. Questi modelli cercano di imparare la struttura profonda dei dati e di generare nuovi campioni sintetici che assomiglino a quelli reali, inclusi quelli della “coda”.

Abbiamo usato questi modelli per generare dati sintetici della nostra caldaia e abbiamo valutato la qualità dei risultati usando diverse metriche:

- Analisi T-SNE: Una visualizzazione che mostra quanto la distribuzione dei dati sintetici assomigli a quella dei dati originali in 2D.

- Punteggio Discriminativo: Misura quanto è difficile per un altro modello distinguere i dati reali da quelli sintetici (più basso è, meglio è).

- Punteggio Predittivo: Misura quanto i dati sintetici siano utili per addestrare un modello di previsione (usando MAE).

- Punteggio Correlazionale: Valuta se le dipendenze temporali nei dati sintetici sono simili a quelle nei dati reali.

I risultati quantitativi (tabelle 3-5 nel paper originale) e l’analisi T-SNE hanno mostrato che, sebbene i modelli generativi funzionino decentemente sull’intero dataset, faticano ancora a generare dati di alta qualità per le classi anomale (la coda). La distribuzione sbilanciata influenza l’addestramento: i modelli diventano bravi a generare campioni comuni ma non quelli rari. C’è ancora lavoro da fare per migliorare la generazione di dati anomali che siano davvero utili per arricchire i dataset e migliorare i modelli per compiti come la classificazione o la previsione delle anomalie.

Perché Questo Dataset è Importante?

Ecco il punto cruciale: questo dataset, con la sua ben definita distribuzione a coda lunga (ricordate, anomalia se la temperatura è fuori dal range 530°C–545°C, circa 8.6% dei casi), è una risorsa preziosa. A differenza di altri dataset di serie temporali, qui abbiamo soglie chiare per definire le anomalie.

Offre una base concreta per ricercatori e sviluppatori che lavorano su:

- Algoritmi di previsione di serie temporali robuste.

- Metodi per affrontare lo sbilanciamento dei dati (imbalanced learning).

- Sviluppo e valutazione di modelli generativi per dati industriali complessi.

- Tecniche di rilevamento anomalie in contesti industriali.

Insomma, spero di avervi trasmesso un po’ della complessità e del fascino che si nascondono dietro l’analisi dei dati provenienti da queste imponenti macchine industriali. La sfida della “coda lunga” è aperta, e avere dati reali come questi è il primo passo per affrontarla!

Fonte: Springer