Svelare i Segreti dei Terremoti: Un Viaggio nel Clustering Spazio-Temporale della Sismicità

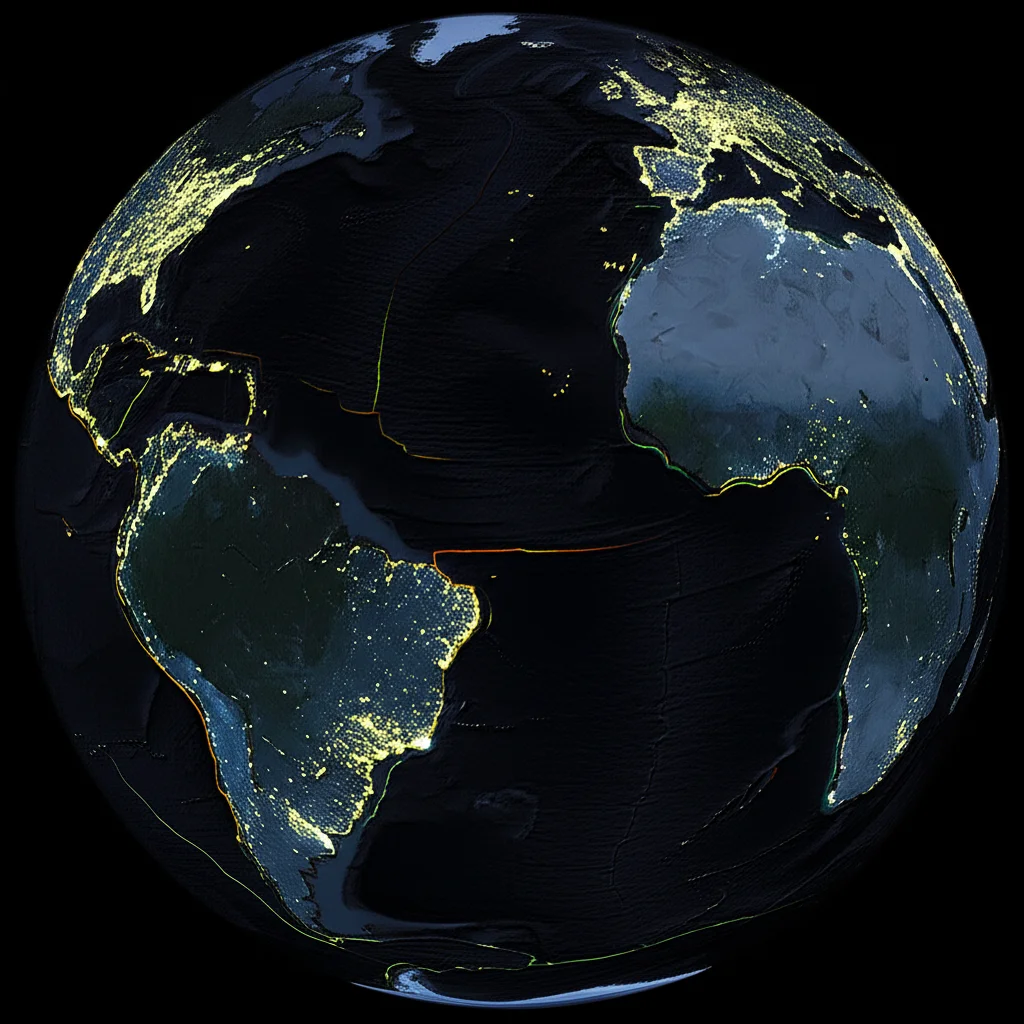

Ciao a tutti! Oggi voglio portarvi in un viaggio affascinante nel cuore pulsante (e a volte tremante) del nostro pianeta. Parleremo di terremoti, ma non solo della loro potenza distruttiva. Cercheremo di capire i loro segreti più nascosti, i pattern che seguono nel tempo e nello spazio, grazie a strumenti potentissimi che chiamiamo algoritmi di clustering. Immaginate di avere una mappa enorme piena di puntini luminosi, ognuno rappresentante un terremoto. Come facciamo a dare un senso a questa miriade di eventi? È qui che entra in gioco la magia del clustering.

Perché Analizzare la Sismicità nel Tempo e nello Spazio?

I terremoti non sono eventi isolati e casuali come potrebbero sembrare. Se guardiamo da vicino, scopriamo che tendono a raggrupparsi, a formare dei “cluster”. Questa tendenza non è una semplice curiosità accademica. Capire come e perché i terremoti si raggruppano è fondamentale per:

- Valutare il rischio sismico in una determinata area.

- Comprendere i meccanismi di innesco (triggering) tra un terremoto e l’altro.

- Migliorare i modelli di previsione (anche se prevedere con esattezza un terremoto è ancora una sfida enorme).

- Studiare le strutture geologiche profonde, come le faglie attive.

La sismicità, ovvero la distribuzione dei terremoti nel tempo e nello spazio, si discosta significativamente da un processo puramente casuale (come il processo di Poisson, per i più tecnici). C’è una correlazione forte, specialmente a breve distanza temporale e spaziale. I cluster possono avere forme strane, allungate, e densità variabili, spesso legate alla magnitudo dei terremoti coinvolti.

Foreshock, Mainshock, Aftershock: Il Balletto Sismico

Quando parliamo di cluster sismici, spesso ci riferiamo a sequenze ben definite:

- Foreshocks (Precursori): Eventi sismici che precedono una scossa più forte nella stessa area. Non sempre presenti, ma a volte possono dare indicazioni (anche se interpretarle è difficilissimo!).

- Mainshock (Scossa Principale): L’evento di magnitudo maggiore all’interno di una sequenza.

- Aftershocks (Repliche): Una serie di scosse, generalmente di magnitudo decrescente, che seguono la scossa principale. Sono la manifestazione più evidente del clustering e possono durare giorni, mesi o addirittura anni. Contribuiscono per un buon 30-40% al numero totale di terremoti registrati globalmente!

Un esempio lampante è stato il terremoto di Gorkha in Nepal nel 2015, preceduto da alcuni foreshock e seguito da una miriade di aftershock. Esistono poi gli sciami sismici (earthquake swarms): gruppi di terremoti di magnitudo moderata che si verificano in un periodo ristretto (ore o giorni) senza una scossa principale chiaramente distinguibile. Spesso sono legati ad aree vulcaniche o geotermiche. Infine, c’è la sismicità di fondo (background seismicity): i terremoti “normali” di una regione, non direttamente collegati a una sequenza specifica, dovuti al lento ma costante movimento delle placche tettoniche.

Il Cuore dei Dati: I Cataloghi Sismici

Tutta questa analisi si basa su un ingrediente fondamentale: i cataloghi sismici. Sono archivi cronologici che contengono informazioni essenziali per ogni terremoto registrato: data e ora, coordinate dell’epicentro (latitudine, longitudine), profondità ipocentrale e magnitudo. A volte includono dati aggiuntivi come meccanismi focali, soluzioni del tensore momento, ecc.

Ottenere un catalogo affidabile, completo e accurato è un’impresa! Richiede reti sismiche dense, strumenti calibrati, software sofisticati e un flusso di lavoro complesso che va dalla raccolta dei dati grezzi (le forme d’onda sismiche) all’identificazione degli eventi (phase picking), alla localizzazione dell’ipocentro e alla stima della magnitudo.

Esistono diversi tipi di cataloghi:

- Pre-strumentali/Storici: Basati su resoconti storici, danni osservati o indagini paleosismologiche (scavando trincee!). Utili per valutare il rischio a lungo termine.

- Strumentali: Basati sulle registrazioni delle reti sismiche moderne (dagli anni ’70 in poi). Sono la risorsa principale per l’analisi statistica e il clustering.

Agenzie come USGS (COMCAT), ISC (ISC-GEM Global Instrumental Earthquake Catalogue) e centri regionali (come l’INGV in Italia) mettono a disposizione questi preziosi dati. Una sfida costante è la completezza del catalogo: sotto una certa magnitudo, detta Magnitudo di Completezza (Mc), non siamo sicuri di aver registrato tutti gli eventi. Determinare Mc è cruciale prima di iniziare qualsiasi analisi di clustering.

Le Leggi Empiriche che Governano i Terremoti

Nel corso degli anni, i sismologi hanno scoperto alcune “regole” empiriche che descrivono aspetti statistici della sismicità, spesso legati al clustering:

- Legge di Gutenberg-Richter: Descrive la relazione tra la magnitudo e il numero di terremoti. In pratica, ci dice che i terremoti piccoli sono molto più frequenti di quelli grandi, seguendo una distribuzione log-lineare. Il parametro ‘b’ (b-value) di questa legge, solitamente vicino a 1, può variare e dare indizi sui processi in atto (ad esempio, tende a diminuire prima di grandi terremoti o nelle sequenze di aftershock).

- Formula di Omori-Utsu: Descrive come il tasso di aftershock diminuisce nel tempo dopo una scossa principale, seguendo una legge di potenza modificata. È fondamentale per stimare la probabilità di future repliche.

- Legge di Bath: Afferma che la differenza di magnitudo tra una scossa principale e la sua replica più forte è più o meno costante (attorno a 1.2), indipendentemente dalla magnitudo della scossa principale.

Queste leggi forniscono un quadro statistico per interpretare i risultati del clustering.

Alla Scoperta dei Cluster: Un Tour tra gli Algoritmi

Ora, facciamo un tuffo nel mondo affascinante degli algoritmi usati per scovare questi cluster spazio-temporali. Ne esistono di diversi tipi, ognuno con i suoi punti di forza e debolezza:

K-Means

È uno degli algoritmi più noti e usati, anche per la sua semplicità. Immaginate di voler dividere i vostri puntini (terremoti) in un numero K prestabilito di gruppi. K-Means cerca di trovare K “centri” (centroidi) e assegna ogni punto al centro più vicino, minimizzando la distanza totale all’interno dei gruppi.

Punti di forza: Semplice, veloce computazionalmente.

Debolezze: Richiede di sapere a priori quanti cluster cercare (K), fatica con cluster di forma non sferica o di densità diversa, sensibile alla scelta iniziale dei centroidi.

Applicazioni: Identificazione di zone sismogenetiche, analisi di rischio sismico.

Fuzzy Clustering (Clustering Sfocato)

A differenza di K-Means che assegna ogni punto a *un solo* cluster (hard clustering), il fuzzy clustering permette a un punto di appartenere a *più* cluster contemporaneamente, con un diverso “grado di appartenenza” (membership grade). È utile quando i confini tra i gruppi non sono netti.

Punti di forza: Gestisce bene cluster sovrapposti e confini incerti.

Debolezze: Più complesso di K-Means, richiede la scelta di parametri (come il grado di “sfocatura”).

Applicazioni: Definizione di zone sismiche potenziali, ridefinizione di strutture di faglia.

Density-Based Clustering (Basato sulla Densità)

Algoritmi come DBSCAN (Density-Based Spatial Clustering of Applications with Noise) funzionano in modo diverso. Non cercano centri, ma aree ad alta densità di punti, separate da aree a bassa densità. Sono bravissimi a trovare cluster di forma arbitraria e a identificare i punti “rumorosi” (outlier) che non appartengono a nessun gruppo.

Punti di forza: Trova cluster di forme complesse, non richiede di specificare il numero di cluster, gestisce il rumore.

Debolezze: Sensibile ai parametri di densità (raggio di vicinato ε e numero minimo di punti MinPts), fatica con cluster a densità molto variabile.

Applicazioni: Identificazione di sorgenti sismiche, rilevamento di sequenze foreshock/aftershock.

Self-Organizing Maps (SOM)

Le SOM sono un tipo di rete neurale artificiale che riduce la dimensionalità dei dati, proiettandoli su una mappa (di solito 2D) preservando le relazioni topologiche. I punti vicini nello spazio originale tendono a finire vicini sulla mappa. È utile per visualizzare e identificare pattern in dati complessi.

Punti di forza: Ottimo per la visualizzazione e l’esplorazione di dati multidimensionali.

Debolezze: Richiede la scelta della dimensione della mappa, l’interpretazione dei cluster sulla mappa può non essere immediata.

Applicazioni: Zonazione tettonica, analisi di precursori.

Clustering Gerarchico

Questo approccio costruisce una gerarchia di cluster. Si parte con ogni punto come un cluster separato (approccio agglomerativo) e si fondono progressivamente i cluster più simili, oppure si parte con tutti i punti in un unico cluster (approccio divisivo) e si divide progressivamente. Il risultato è un dendrogramma, un diagramma ad albero che mostra la struttura gerarchica.

Punti di forza: Non richiede di specificare il numero di cluster, fornisce una visualizzazione intuitiva (dendrogramma).

Debolezze: Computazionalmente costoso per grandi dataset, sensibile alla metrica di distanza e al criterio di linkage (come si misura la distanza tra cluster).

Applicazioni: Identificazione di sorgenti sismiche omogenee, regionalizzazione tettonica.

Approcci Basati su Grafi e Reti

Possiamo vedere i terremoti come nodi di una rete, connessi se sono “vicini” in qualche modo (spazio, tempo, magnitudo). Analizzando le proprietà di questa rete (come la distribuzione dei gradi, il coefficiente di clustering, il cammino minimo medio), possiamo scoprire pattern interessanti. Alcuni studi hanno mostrato che le reti sismiche hanno proprietà “scale-free” e “small-world”.

Punti di forza: Cattura relazioni complesse e non lineari.

Debolezze: La definizione di “connessione” può essere arbitraria, l’analisi può essere complessa.

Applicazioni: Studio dell’evoluzione temporale della sismicità, analisi della correlazione tra eventi.

Computazione Evolutiva

Algoritmi ispirati alla biologia evolutiva (come algoritmi genetici, Particle Swarm Optimization – PSO) possono essere usati per “ottimizzare” la suddivisione in cluster, cercando la partizione che massimizza/minimizza una certa funzione di qualità (fitness function).

Punti di forza: Robusti, capaci di trovare soluzioni globali in spazi complessi.

Debolezze: Computazionalmente intensivi, richiedono un’attenta definizione della funzione fitness e dei parametri evolutivi.

Applicazioni: Ottimizzazione del numero di cluster, identificazione automatica di zone sismiche.

Modelli Spazio-Temporali (ETAS)

L’Epidemic-Type Aftershock Sequence (ETAS) è un modello statistico (point-process) molto popolare che descrive la sismicità come un processo auto-eccitante: ogni terremoto (sia di fondo che una replica) può generarne altri (le sue “repliche”). Modella esplicitamente la dipendenza temporale e spaziale.

Punti di forza: Fornisce una base fisica/statistica robusta, quantifica il triggering.

Debolezze: Matematicamente complesso, richiede stime di parametri.

Applicazioni: Simulazione di sequenze sismiche, previsione di aftershock, declustering.

Declustering: Isolare il Rumore di Fondo

A volte, l’obiettivo non è trovare i cluster, ma rimuoverli! Il declustering (o de-raggruppamento) mira a identificare e separare gli eventi dipendenti (foreshock, aftershock) dalla sismicità di fondo indipendente. Questo è cruciale per la valutazione del rischio sismico a lungo termine (PSHA – Probabilistic Seismic Hazard Assessment), che spesso si basa sull’assunzione che gli eventi di fondo seguano un processo di Poisson (cioè, siano casuali e indipendenti).

Anche qui, esistono vari metodi:

- Metodi basati su Finestre Spazio-Temporali: Definiscono una “finestra” di influenza attorno a ogni potenziale mainshock (la dimensione della finestra dipende dalla magnitudo). Gli eventi che cadono dentro la finestra sono considerati dipendenti. (Es: Gardner e Knopoff, Reasenberg). Semplici ma un po’ rigidi.

- Metodi basati su Link: Collegano eventi vicini in spazio-tempo formando catene o cluster. (Es: Single-Link Cluster).

- Declustering Stocastico: Usano modelli come ETAS per calcolare la probabilità che ogni evento sia di fondo o una replica. (Es: Zhuang et al., Marsan e Lengline – MISD). Più sofisticati ma richiedono assunzioni sul modello.

- Metodi basati su Distanza/Tempo Inter-Evento: Analizzano la distribuzione delle distanze spaziali (IED) e temporali (IET) tra eventi successivi. I cluster tendono ad avere IET e IED piccoli. (Es: NND – Nearest-Neighbor Distance di Zaliapin et al.). Non richiedono modelli specifici ma la soglia di separazione può essere difficile da definire.

- Approcci basati su Machine Learning/AI: Recentemente, si usano classificatori (Random Forest), modelli HMM (Hidden Markov Model) o algoritmi di ottimizzazione (PSO, Chimp Optimization) per separare i due tipi di sismicità, spesso superando i metodi tradizionali.

Il declustering è un problema complesso e non esiste un metodo universalmente “migliore”. La scelta dipende dal catalogo, dalla regione e dall’obiettivo specifico.

Valutare la Qualità: Come Capire se Abbiamo Fatto Bene?

Ok, abbiamo applicato il nostro algoritmo preferito. Ma come sappiamo se i cluster trovati (o la sismicità di fondo isolata) sono “buoni”? Esistono diverse metriche e test statistici per valutare la qualità del clustering/declustering:

- Indici Interni: Misurano la compattezza (quanto sono vicini i punti nello stesso cluster) e la separazione (quanto sono distanti i cluster tra loro). Esempi: Silhouette Index, Davies-Bouldin Index, Calinski-Harabasz Index. Utili per confrontare diverse partizioni ottenute dallo stesso algoritmo (es. con K diversi in K-Means).

- Indici Esterni: Confrontano la partizione trovata con una “verità di base” (ground truth), se disponibile (raro in sismologia).

- Test Statistici: Verificano se la sismicità residua (dopo il declustering) segue effettivamente un processo di Poisson (es: test Chi-quadro, analisi del Coefficiente di Variazione – COV).

- Metriche Specifiche: Indice di Morisita (per pattern spaziali), metrica TM (per ergodicità), Entropia, metriche basate su reti.

La valutazione è fondamentale per dare fiducia ai risultati e capire i limiti del metodo usato.

L’Intelligenza Artificiale: Un Alleato Potente (e il Futuro)

L’Intelligenza Artificiale (AI), in particolare il Machine Learning (ML) e il Deep Learning (DL), sta rivoluzionando anche l’analisi della sismicità. Questi strumenti sono potentissimi nell’identificare pattern complessi e non lineari in grandi moli di dati, superando spesso i metodi tradizionali.

Vediamo AI/ML/DL applicati a:

- Rilevamento e classificazione di eventi sismici (anche molto piccoli).

- Phase picking automatico e accurato.

- Localizzazione precisa degli ipocentri.

- Previsione di aftershock (localizzazione e magnitudo).

- Clustering e declustering più sofisticati.

- Riconoscimento di pattern precursori (anche se con molta cautela).

Tuttavia, ci sono sfide:

- Dati: Servono grandi dataset etichettati per addestrare i modelli (spesso scarsi).

- Interpretabilità: I modelli DL (“black box”) possono essere difficili da interpretare fisicamente. Come colleghiamo i risultati ai processi geologici reali?

- Computazione: L’addestramento di modelli complessi richiede risorse significative.

Il futuro probabilmente vedrà modelli ibridi, che combinano la potenza dei dati (ML/DL) con la conoscenza fisica (modelli come ETAS, leggi empiriche, vincoli geologici). L’obiettivo è ottenere modelli più accurati, robusti e interpretabili. Altre direzioni future includono algoritmi di clustering/declustering in tempo reale, migliore integrazione di dati da diverse fonti (sismici, geodetici, satellitari) e piattaforme collaborative aperte.

In conclusione, l’analisi spazio-temporale della sismicità tramite clustering e declustering è un campo di ricerca dinamico e cruciale. Ci permette di decifrare il linguaggio complesso dei terremoti, svelando pattern nascosti che sono fondamentali per comprendere i processi tettonici e migliorare la valutazione del rischio sismico. Gli algoritmi diventano sempre più sofisticati, e l’avvento dell’AI apre scenari entusiasmanti. Certo, le sfide restano, ma ogni passo avanti ci avvicina a una migliore comprensione del nostro pianeta e, speriamo, a comunità più sicure e resilienti.

Fonte: Springer