Robot con l’Anima (o Quasi): Come la Classe Sociale e la “Timidezza” Influenzano la Nostra Reazione all’IA Umanoide

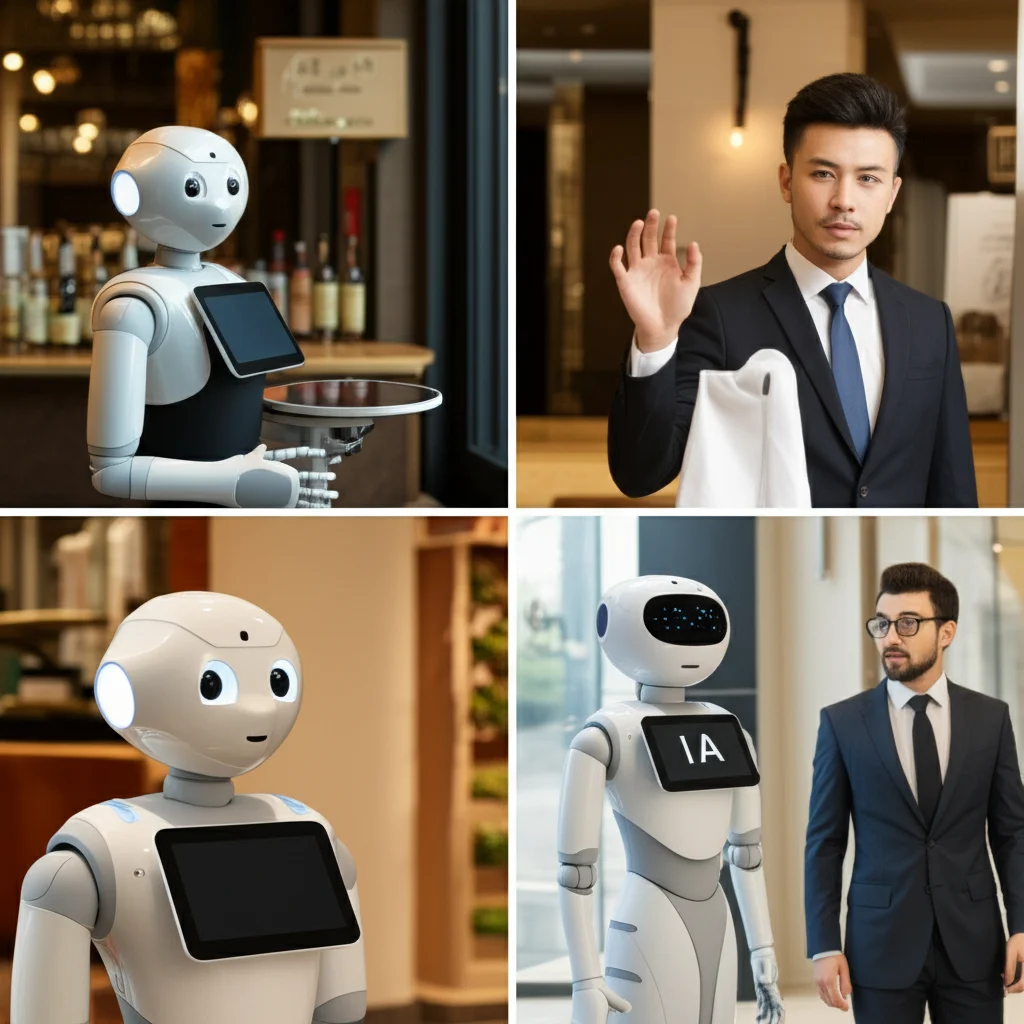

Amici, parliamoci chiaro: l’intelligenza artificiale è ormai parte della nostra quotidianità. Dai chatbot che ci assistono online ai robot che servono ai tavoli, l’interazione uomo-macchina sta diventando la nuova normalità. Ma come reagiamo davvero quando queste macchine iniziano ad assomigliare un po’ troppo a noi, sia nell’aspetto che nel comportamento? È una domanda che mi affascina da tempo, e pare che non sia l’unico!

Recentemente mi sono imbattuto in uno studio davvero interessante che getta nuova luce su questo argomento, intitolato (in originale, per i puristi) “Social class, public self-awareness, and consumers’ heterogeneous attitude to AI machine anthropomorphism”. In pratica, si cerca di capire perché alcuni di noi accolgono a braccia aperte un robot con fattezze umane, mentre altri storcono il naso o, peggio, si sentono a disagio.

Il Dilemma dell’Antropomorfismo: Amici o Minacce?

Sapete, da un po’ si discute sull’effetto che l’antropomorfismo – ovvero dare caratteristiche umane a ciò che umano non è – ha su di noi quando si parla di IA. C’è chi, seguendo la teoria della “Valle Perturbante” (Uncanny Valley), sostiene che un robot troppo simile all’uomo, ma non perfettamente identico, ci provochi una sorta di repulsione. Immaginate un automa che vi sorride, ma con un sorriso un po’ “sbagliato”: brividi, vero? Questo potrebbe spingerci a non volerlo usare, soprattutto se ci offre servizi personalizzati, facendoci sentire quasi “spiati”.

Dall’altro lato, però, c’è chi dice che un IA con tratti umani possa migliorare il nostro senso di presenza sociale e farci apprezzare di più l’interazione. Pensate a un assistente virtuale che capisce le vostre emozioni e risponde con empatia: potrebbe creare un legame, una sorta di intimità che ci spinge a interagire più volentieri. Insomma, un bel dilemma!

La Chiave è in Noi: Consapevolezza di Sé e Classe Sociale

E qui, amici miei, entra in gioco lo studio che vi menzionavo. Gli autori suggeriscono che la chiave per capire queste reazioni divergenti sta proprio nella nostra eterogeneità come consumatori. In particolare, due fattori sembrano cruciali: la nostra consapevolezza pubblica di sé (quanto ci preoccupiamo di come appariamo agli altri) e la nostra classe sociale.

Partiamo da un presupposto: per offrirci servizi personalizzati e di alta qualità, queste IA antropomorfe devono “scavare” nei nostri dati. E questo, inevitabilmente, solleva il fantasma della privacy. Chi di noi non si è chiesto almeno una volta dove vanno a finire le informazioni che condividiamo?

Lo studio ha condotto tre esperimenti, ambientati in ristoranti, hotel e negozi, per testare le sue ipotesi. E i risultati sono piuttosto illuminanti!

Privacy, Questa Sconosciuta (o Troppo Conosciuta?)

Prima scoperta interessante: la relazione tra il grado di antropomorfismo dell’IA e le nostre preoccupazioni per la privacy non è lineare, ma segue una curva a U rovesciata. Cosa significa? Che le nostre preoccupazioni per la privacy sono massime quando interagiamo con un robot mediamente antropomorfo. Se il robot è poco umanoide (sembra una macchina e basta) o, al contrario, è estremamente simile a un umano (tanto da sembrarci quasi affidabile e capace), le nostre ansie per la privacy diminuiscono.

Pensateci: un robot palesemente meccanico non ci fa temere chissà quali intrusioni. Uno super-avanzato e iper-realistico, forse, ci dà l’impressione di un servizio talmente evoluto da “meritare” i nostri dati, bilanciando rischi e benefici. È quello di mezzo, quello che “vorrebbe ma non può” essere del tutto umano, a farci drizzare le antenne della privacy!

E, come c’era da aspettarsi, maggiori preoccupazioni per la privacy si traducono in una minore intenzione di utilizzare queste macchine. Questo porta a un’altra scoperta: la relazione tra antropomorfismo dell’IA e intenzione d’uso segue una curva a U. In pratica, siamo più propensi a usare robot poco antropomorfi o molto antropomorfi, mentre quelli “nel mezzo” ci convincono meno.

L’Effetto “Specchio”: Quanto Conta Sentirsi Osservati

Ora entra in gioco la consapevolezza pubblica di sé. Immaginate di essere persone che si preoccupano molto di come gli altri le vedono, di come il loro comportamento viene giudicato. Quando interagiamo con un’IA che percepiamo come “intelligente” o “sociale” (grazie al suo aspetto umanoide, al tono di voce, ecc.), questa nostra consapevolezza di sé può amplificarsi. Ci sentiamo più “sotto esame”.

Lo studio ha scoperto che questa consapevolezza pubblica di sé modera positivamente la relazione a U rovesciata tra antropomorfismo e preoccupazioni per la privacy. In parole povere: se siamo persone con un’alta consapevolezza pubblica di sé, l’effetto “picco di preoccupazione per la privacy con IA mediamente antropomorfe” è ancora più forte. Tendiamo a essere più guardinghi e meno disposti a rivelare informazioni personali, aumentando le nostre preoccupazioni per la privacy.

- Le persone con alta consapevolezza pubblica di sé mostrano una curva più ripida: le loro preoccupazioni per la privacy aumentano e diminuiscono più drasticamente al variare dell’antropomorfismo.

- Interessante notare che, con IA poco o molto antropomorfe, chi ha un’alta consapevolezza di sé mostra minori preoccupazioni per la privacy rispetto a chi ne ha poca. Forse perché, in questi casi, la situazione è più “chiara” e meno ambigua, riducendo l’ansia da “giudizio sociale”.

Dimmi a Che Classe Appartieni e Ti Dirò Che Robot Preferisci

E veniamo all’ultimo, ma non meno importante, fattore: la classe sociale. Sembra incredibile, ma il nostro background socio-economico (reddito, istruzione, occupazione) modella le nostre percezioni e, di conseguenza, la nostra accettazione delle novità, inclusi i robot umanoidi.

Secondo la teoria della classe sociale, chi appartiene a classi sociali inferiori tende ad avere meno risorse, vive in ambienti più incerti e ha una maggiore sensibilità alle minacce, con un minor senso di controllo sul mondo esterno. Al contrario, chi appartiene a classi sociali superiori ha più risorse, un background educativo migliore e un maggior senso di controllo, sviluppando un orientamento più auto-centrato.

Cosa c’entra tutto questo con i robot? Beh, lo studio ha rivelato che:

- I consumatori di classe sociale più elevata mostrano una preferenza per le macchine IA con un alto grado di antropomorfismo. Forse le vedono come servitori utili, un segno di trattamento preferenziale, e si aspettano che un robot più “umano” offra un servizio migliore.

- I consumatori di classe sociale più bassa, invece, preferiscono macchine IA con un basso grado di antropomorfismo. Potrebbero essere più critici, percepire i robot più umanoidi come una minaccia (magari anche per il proprio lavoro) o semplicemente pensare che servizi così “sofisticati” non siano alla loro portata economica.

Quindi, la nostra classe sociale influenza direttamente la relazione a U tra antropomorfismo e intenzione d’uso, ma in modo specifico: chi sta “più in alto” nella scala sociale è più propenso ad usare robot molto umanoidi, mentre chi sta “più in basso” preferisce quelli meno umanoidi. La fascia media di antropomorfismo, invece, non sembra mostrare differenze significative tra le classi.

Cosa Ci Insegna Tutto Questo? Implicazioni Pratiche (e Qualche Spunto per il Futuro)

Beh, per me queste scoperte sono oro colato! Dal punto di vista teorico, arricchiscono la nostra comprensione di come reagiamo all’IA e supportano l’idea che le nostre decisioni sulla privacy siano un calcolo tra rischi e benefici. Dimostrano anche come l’antropomorfizzazione dell’IA sollevi questioni etiche, soprattutto per le classi sociali più vulnerabili.

Ma pensiamo alle implicazioni pratiche. Le aziende che vogliono introdurre robot nei servizi (e sono tante, pensate che entro il 2030 si stima che i robot di servizio costituiranno il 25% della forza lavoro nel settore dell’ospitalità!) dovrebbero fare molta attenzione:

- Evitare il “medio” antropomorfismo: Se l’obiettivo è ridurre le preoccupazioni per la privacy, meglio puntare su robot chiaramente meccanici o, se il budget e la tecnologia lo consentono, su quelli estremamente realistici. Quelli “nel mezzo” sembrano essere i più problematici.

- Considerare la consapevolezza pubblica di sé: Quando si raccolgono dati sensibili, e si sa che l’interazione potrebbe aumentare la consapevolezza di sé del consumatore, l’uso di IA poco o molto antropomorfe potrebbe essere preferibile, poiché in questi casi chi ha alta consapevolezza di sé mostra minori preoccupazioni. Forse, per una questione di costi e semplicità, le IA poco antropomorfe sono la scelta più sicura ed economica per le aziende.

- Segmentare in base alla classe sociale: Le aziende dovrebbero considerare la classe sociale del loro target. Un hotel di lusso potrebbe optare per robot altamente antropomorfi, mentre un servizio pubblico o un negozio con una clientela più eterogenea potrebbe preferire macchine meno “umane” o offrire diverse opzioni.

Certo, lo studio ha le sue limitazioni: il campione era principalmente composto da giovani con istruzione universitaria, e l’uso di piattaforme online per reclutare partecipanti potrebbe introdurre dei bias. Inoltre, gli esperimenti erano in contesti controllati, e la vita reale è sempre più complessa. E non dimentichiamo il fattore culturale! In contesti collettivisti come quello cinese, l’IA potrebbe essere vista diversamente rispetto a culture più individualiste. Future ricerche potrebbero esplorare queste differenze, magari usando la realtà virtuale per simulare ambienti più realistici o indagando altri fattori psicologici.

Nonostante ciò, trovo che questo studio ci offra una lente affascinante per guardare al nostro rapporto con l’IA. Non siamo tutti uguali di fronte a un robot che ci sorride, e capire queste differenze è fondamentale per progettare un futuro in cui la tecnologia sia davvero al servizio di tutti, e non una fonte di ansia o disagio. E voi, che tipo di robot preferireste incontrare al ristorante?

Fonte: Springer