AstroSage: L’IA da 8 Miliardi di Parametri che Sfida GPT-4o nel Campo dell’Astronomia!

Ciao a tutti, appassionati di stelle e tecnologia! Oggi voglio raccontarvi una storia affascinante che unisce due mondi apparentemente distanti: l’immensità dell’universo e la potenza crescente dell’intelligenza artificiale. Immaginate di avere un assistente AI super esperto, capace di rispondere alle vostre domande più complesse su galassie lontane, buchi neri o sulla strumentazione usata per scrutare il cosmo. Sembra fantascienza? Non più!

La Sfida: Creare un Cervello Artificiale per l’Astronomia

Nel mondo dell’IA, i Modelli Linguistici di Grandi Dimensioni (LLM) come GPT-4 sono diventati strumenti incredibilmente potenti, capaci di scrivere, programmare, e persino fare brainstorming. Anche noi astronomi li usiamo sempre di più per analizzare dati, cercare informazioni o semplicemente per avere spiegazioni chiare su concetti complessi. Tuttavia, questi modelli “generalisti”, pur essendo potentissimi, non sempre hanno quella conoscenza ultra-specifica che serve in un campo così tecnico come il nostro.

La domanda che ci siamo posti è stata: e se potessimo creare un LLM specializzato? Un modello addestrato fin dall’inizio con un’unica missione: diventare un esperto assoluto di astronomia, astrofisica, cosmologia e strumentazione astronomica. Studi precedenti avevano suggerito che modelli più piccoli, ma focalizzati su un dominio specifico, potevano eguagliare o superare i giganti generalisti. Era una scommessa intrigante. Tentativi precedenti nel campo astronomico, come AstroLLaMA, avevano mostrato potenziale, ma non erano riusciti a superare nettamente i modelli di base da cui derivavano, a volte addirittura peggiorando le performance a causa di problemi nel training. Serviva un approccio diverso, più massiccio e curato.

Nasce AstroSage: Un Addestramento Cosmico

Così è nato il progetto AstroSage-Llama-3.1-8B. Siamo partiti da una base solida: il modello Llama-3.1 di Meta, con 8 miliardi di parametri, già noto per le sue ottime capacità generali e disponibile con una licenza permissiva. Ma la vera magia è iniziata con l’addestramento.

Abbiamo letteralmente “nutrito” il modello con una quantità spropositata di conoscenza astronomica. Parliamo di:

- Circa 250.000 articoli scientifici pre-print da arXiv (il database principale per la ricerca in fisica e astronomia) pubblicati tra il 2007 e il 2024.

- Quasi 30.000 articoli da Wikipedia, selezionati accuratamente dalle categorie di astronomia e astrofisica.

- Circa 800 libri di testo specialistici in formato digitale.

Convertire tutto questo materiale, spesso in PDF, in un formato digeribile per l’IA (usando tecnologie come Nougat OCR per estrarre testo e formule matematiche) è stata un’impresa titanica. Ma non bastava la quantità, serviva la qualità. Abbiamo implementato procedure di pulizia sofisticate, basate sulla “perplessità” (una misura di quanto il testo sia prevedibile e ben formato per un modello linguistico), scartando circa il 2% dei dati che sembravano corrotti o di bassa qualità. L’addestramento vero e proprio (chiamato Continued Pre-Training o CPT) è avvenuto su uno dei supercomputer più potenti al mondo, il Frontier dell’ORNL, usando centinaia di processori grafici in parallelo. Non è stato facile: abbiamo dovuto calibrare attentamente i parametri di apprendimento per evitare che il modello “impazzisse” o imparasse troppo lentamente, combattendo anche con i limiti di tempo imposti dall’infrastruttura.

Insegnare a Rispondere: Il Fine-Tuning Supervisionato (SFT)

Avere un modello pieno di conoscenza non basta. Deve anche saperla usare per rispondere a domande specifiche e seguire istruzioni. Qui entra in gioco il Fine-Tuning Supervisionato (SFT). Ci siamo resi conto che uno dei punti deboli dei modelli precedenti era proprio la scarsità di dati per questa fase.

Quindi, abbiamo fatto le cose in grande: abbiamo generato sinteticamente oltre 11 milioni di coppie Domanda-Risposta basate sugli articoli scientifici del nostro dataset. Ma non ci siamo accontentati! Abbiamo usato un altro LLM per valutare ogni singola coppia secondo criteri rigorosi:

- Correttezza: L’informazione è scientificamente accurata?

- Autonomia: La domanda e la risposta si capiscono da sole, senza contesto extra?

- Pertinenza: È una domanda interessante per un ricercatore o studente di astronomia?

- Qualità Generale: È una coppia utile e ben formulata?

Solo le coppie che hanno ottenuto il massimo punteggio in tutte le categorie (circa 8.8 milioni!) sono state tenute. Abbiamo aggiunto anche altri dataset: uno generale per migliorare la capacità di conversazione (Infinity-Instruct), uno con riassunti sintetici degli articoli, e uno basato sui metadati (autori, date, titoli) per permettere agli utenti di riferirsi a paper specifici (anche se, ammettiamo, su quest’ultimo punto il modello non è ancora infallibile). In totale, il dataset SFT conteneva circa 2 miliardi di “token” (le unità di testo che l’IA processa). Anche questa fase è stata eseguita sul supercomputer Frontier, spingendo al massimo l’apprendimento nei limiti di tempo disponibili.

Il Tocco Finale: La Fusione dei Modelli

Dopo il CPT e l’SFT, il nostro AstroSage era diventato un vero esperto di astronomia. Tuttavia, nelle conversazioni più complesse o quando si chiedevano output con uno stile particolare, notavamo che mancava ancora qualcosa rispetto alla versione “Instruct” di Llama-3.1, quella rilasciata da Meta e addestrata con risorse enormi per essere un ottimo conversatore generale.

La soluzione? La fusione di modelli (Model Merging). Usando una tecnica chiamata DARE-TIES, abbiamo combinato il nostro modello specializzato (AstroSage-SFT) con il modello Llama-3.1-Instruct. Non è stata una fusione 50/50: abbiamo dato più peso al nostro modello (75%) e aggiunto un pizzico (25%) delle capacità conversazionali del modello Instruct. L’obiettivo era ottenere il meglio dei due mondi: l’enorme conoscenza astronomica specifica e la fluidità nel dialogo. E ha funzionato!

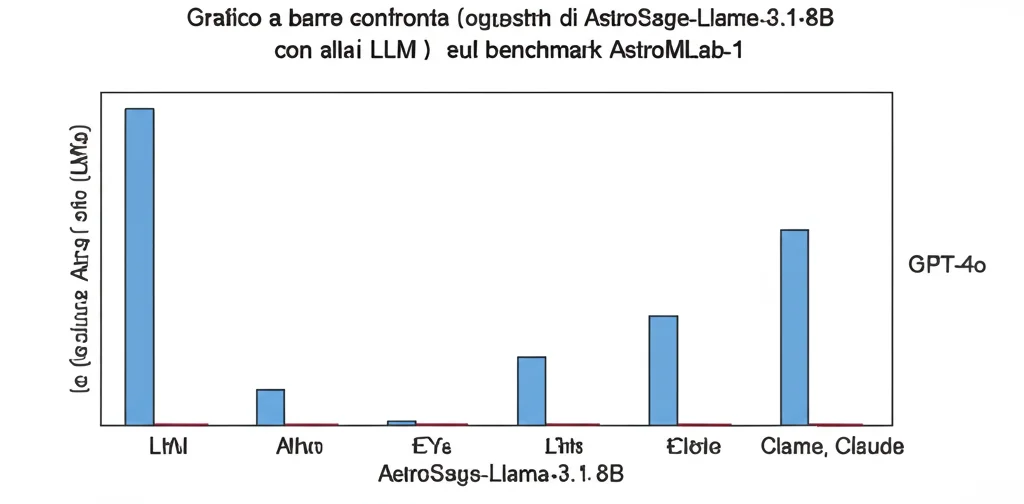

La Prova del Nove: I Risultati del Benchmark

Ma come misurare oggettivamente le capacità di AstroSage? Abbiamo usato il benchmark AstroMLab-1, un set di 4425 domande a risposta multipla di alta qualità, verificate da umani, che coprono tutti gli ambiti dell’astronomia. È importante sottolineare che gli articoli usati per creare queste domande sono stati deliberatamente esclusi dal nostro training, per assicurarci che il modello non stesse semplicemente “ricordando a memoria” le risposte, ma dimostrando una reale comprensione.

I risultati sono stati sbalorditivi. AstroSage-Llama-3.1-8B ha ottenuto un punteggio dell’80.9%! Per darvi un’idea:

- Supera nettamente tutti gli altri modelli della sua classe (8 miliardi di parametri).

- È praticamente alla pari con GPT-4o di OpenAI (80.4%).

- È molto meglio del modello di base da cui siamo partiti, Llama-3.1-8B (72.9%), dimostrando un miglioramento di 8 punti percentuali.

- Supera significativamente le performance di esperti umani nel campo (che si attestano intorno al 68% su questo test specifico, fatto senza aiuti esterni).

La cosa ancora più incredibile è il rapporto costo-efficacia. AstroSage raggiunge queste performance con un costo di inferenza (cioè il costo per usarlo) che è circa 1000 volte inferiore a quello dei modelli proprietari come GPT-4o e 100 volte inferiore a quello dei modelli open-weight più grandi. È la prima volta che un LLM specializzato in astronomia dimostra un miglioramento così netto e verificato rispetto al suo modello base.

Abbiamo anche verificato che la specializzazione non avesse compromesso le capacità generali. Testando AstroSage su benchmark standard di ragionamento, matematica e programmazione, abbiamo visto che, grazie alla fusione, ha mantenuto performance solide, paragonabili a quelle del modello Llama-3.1-Instruct originale. C’è stato un piccolo calo nella capacità di seguire istruzioni molto specifiche (benchmark IF-EVAL), ma nel complesso abbiamo preservato un ottimo equilibrio. Infine, in un test “alla cieca”, degli valutatori umani hanno preferito le risposte di AstroSage a quelle di Llama-3.1-Instruct nel 73% dei casi, su domande di cosmologia di varia difficoltà.

Cosa Significa Tutto Questo e Cosa Ci Riserva il Futuro?

Questo risultato è entusiasmante! Dimostra che non servono necessariamente modelli giganteschi da centinaia di miliardi di parametri per ottenere performance da leader in un settore specifico. Con un’attenta cura dei dati e un addestramento mirato, anche un modello relativamente “piccolo” da 8 miliardi di parametri può diventare un campione nel suo campo.

Questo apre porte incredibili per la ricerca e l’educazione in astronomia. Avere un assistente AI così potente, ma molto più economico da usare, lo rende accessibile a università, istituti di ricerca e persino a singoli studenti o appassionati che non potrebbero permettersi i costi dei modelli più grandi. Immaginate futuri “agenti scientifici” capaci di analizzare autonomamente dati dal James Webb Space Telescope, fare ricerche bibliografiche o persino formulare nuove ipotesi. AstroSage è un passo fondamentale in quella direzione.

Ovviamente, il lavoro non finisce qui. Ci sono ancora sfide, come migliorare la capacità di ragionamento multi-step e la memoria per contesti lunghi. Il nostro prossimo obiettivo è applicare questa stessa metodologia a un modello più grande, della classe dei 70 miliardi di parametri, per puntare a performance ancora superiori. Stiamo anche lavorando a benchmark più specifici per l’astronomia e a integrare tecniche come il Retrieval-Augmented Generation (RAG) per dare al modello accesso a conoscenze sempre aggiornate.

La buona notizia è che abbiamo reso AstroSage-Llama-3.1-8B liberamente disponibile per tutta la comunità scientifica sotto licenza Llama 3.1 Community License. Potete trovarlo su Hugging Face! Speriamo che questo possa stimolare ulteriore innovazione e collaborazione.

In conclusione, AstroSage non è solo un modello linguistico; è la prova che la specializzazione intelligente può democratizzare l’accesso all’intelligenza artificiale di frontiera, aprendo nuovi orizzonti per la scoperta scientifica. Il cielo, a quanto pare, non è più il limite, nemmeno per l’IA!

Fonte: Springer