Fratture Vertebrali? Ci Pensa l’AI: Il Mio Viaggio con Vision Transformer e GAN per Diagnosi Automatiche

Ciao a tutti! Oggi voglio raccontarvi di un’avventura nel mondo dell’intelligenza artificiale applicata alla medicina, un campo che mi affascina enormemente. Immaginate di poter aiutare i medici a identificare rapidamente e con precisione un problema complesso come le fratture della colonna vertebrale (VCF – Vertebral Column Fracture). Sembra fantascienza? Beh, non proprio! Con il mio team, abbiamo esplorato come combinare tecnologie AI all’avanguardia per creare uno strumento diagnostico potente.

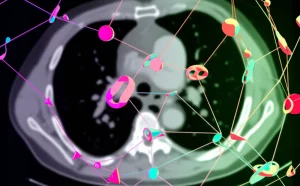

Le fratture vertebrali, spesso causate da traumi come cadute, incidenti sportivi o stradali, possono avere conseguenze serie, dal dolore cronico alla paralisi. La Tomografia Computerizzata (TAC) è uno strumento fantastico per vederle, ma distinguere i vari tipi e sottotipi di frattura (pensate alle classificazioni A, B, C con tutte le loro varianti come A1, A2, B1…) non è affatto semplice, nemmeno per un radiologo esperto. C’è sempre il rischio di interpretazioni diverse (la cosiddetta variabilità inter-osservatore) e il tempo è cruciale. Da qui è nata la nostra sfida: possiamo creare un sistema automatico che dia una mano?

Il Problema: Occhi Esperti Ma Non Infallibili

La colonna vertebrale è una struttura incredibilmente complessa, il pilastro del nostro corpo. Una frattura qui può significare frammenti ossei che premono sul midollo spinale, con esiti potenzialmente devastanti. La classificazione delle fratture è fondamentale per decidere il trattamento giusto, ma le differenze tra un tipo e l’altro possono essere minime, quasi sfumature visibili solo nelle immagini TAC.

Ecco alcuni esempi per capire la complessità:

- Tipo A (Compressione):

- A1 (Wedge compression): Rottura della parte anteriore o centrale, senza coinvolgere il muro posteriore.

- A2 (Split): Rottura di entrambe le “endplate” (le superfici superiore e inferiore della vertebra), sempre senza danni al muro posteriore.

- A3 (Burst incompleto): Frattura di una endplate e del muro posteriore.

- A4 (Burst completo): Frattura di entrambe le endplate e del muro posteriore.

- Tipo B (Distrazione): Coinvolgono danni ai legamenti o alle strutture che tengono unite le vertebre posteriormente (la “tension band”).

- Tipo C (Traslazione): Implicano uno spostamento della vertebra in qualsiasi direzione.

Capite bene che distinguere tra un A2 e un A3, o tra i vari tipi B, richiede un occhio allenatissimo e tempo. Un sistema automatico basato su Deep Learning (DL) potrebbe accelerare il processo e renderlo più oggettivo.

La Nostra Idea: Un “Dream Team” di Intelligenze Artificiali

Abbiamo pensato: perché affidarsi a un solo tipo di AI quando possiamo metterne insieme diverse, ognuna con i suoi punti di forza? È qui che entra in gioco il concetto di modello ensemble.

Abbiamo iniziato esplorando alcuni campioni del Deep Learning, come le reti neurali convoluzionali (CNN) tipo VGG16, ResNet50 e DenseNet121. Queste reti sono bravissime a riconoscere pattern locali nelle immagini, come linee di frattura, bordi, texture ossee. Dopo vari test, VGG16 e ResNet50 si sono rivelate particolarmente promettenti per il nostro set di dati di TAC vertebrali.

Ma le CNN hanno un limite: faticano un po’ a “vedere il quadro generale”, a capire le relazioni a lunga distanza all’interno dell’immagine. Qui entra in scena il Vision Transformer (ViT). Questa tecnologia, mutuata dal mondo dell’elaborazione del linguaggio naturale, è incredibilmente efficace nel catturare le dipendenze globali, la forma complessiva, il contesto. È come se il ViT guardasse l’intera vertebra e le sue vicine per capire la dinamica della frattura.

La nostra scommessa è stata quella di creare un modello ensemble pesato: unire le previsioni dei migliori modelli DL (VGG16 e ResNet50) e del ViT, dando un “peso” diverso a ciascuno in base alla sua performance. L’idea è che combinando chi è bravo sui dettagli (DL) con chi è bravo sulla visione d’insieme (ViT), si ottenga un risultato superiore alla somma delle parti. Un vero “dream team” AI!

Pochi Dati? Creiamone di Nuovi (con Stile)!

Uno dei problemi classici quando si addestra un’AI, specialmente in campo medico, è la scarsità di dati. Avevamo un buon numero di immagini TAC (circa 2820, raccolte eticamente dal Kasturba Medical College in India), ma per addestrare modelli complessi e evitare che “imparino a memoria” (overfitting), più dati ci sono, meglio è. Inoltre, alcuni tipi di frattura sono più rari di altri, creando uno squilibrio.

La soluzione? La data augmentation. Ma invece di usare solo tecniche classiche (ruotare, zoomare, capovolgere le immagini), abbiamo deciso di spingerci oltre usando le Reti Generative Avversarie (GAN). Le GAN sono fantastiche perché imparano a creare immagini sintetiche incredibilmente realistiche. Abbiamo sviluppato versioni “potenziate” di due tipi di GAN:

- Extended DCGAN (Deep Convolutional GAN): Una versione migliorata per generare immagini TAC da 256×256 pixel.

- PGGAN (Progressive Growing GAN): Questa è ancora più sofisticata. Inizia generando immagini a bassa risoluzione (4×4 pixel!) e poi aggiunge progressivamente strati per aumentare la qualità fino a 256×256 o più. Impara i dettagli un po’ alla volta, risultando in immagini sintetiche di qualità superiore.

Usando queste GAN, abbiamo “gonfiato” il nostro dataset, specialmente per le classi di fratture meno rappresentate, fornendo ai nostri modelli AI più esempi da cui imparare, più variabilità, e riducendo il rischio di overfitting.

Mettiamo Alla Prova il Nostro Campione

Dopo aver preparato i dati (reali e sintetici) e definito l’architettura del nostro “dream team” (l’ensemble pesato VGG16-ResNet50-ViT), è arrivato il momento della verità: i test!

Abbiamo confrontato diverse configurazioni:

- Modelli DL singoli (VGG16, ResNet50…).

- Ensemble di soli modelli DL (es. VGG16+ResNet50).

- Il ViT da solo.

- Il nostro ensemble pesato finale (VGG16-ResNet50-ViT).

E abbiamo valutato l’impatto dell’aumento dei dati con DCGAN e PGGAN. I risultati sono stati davvero incoraggianti!

Il solo ensemble VGG16-ResNet50 ha raggiunto un’accuratezza dell’81.83%. Non male, ma si poteva fare di meglio. Il ViT da solo ha fatto un balzo in avanti, arrivando all’86.28%, dimostrando la sua forza nel capire il contesto globale delle fratture.

Ma la vera magia è avvenuta con il nostro ensemble pesato VGG16-ResNet50-ViT. Già senza dati sintetici aggiuntivi, ha toccato l’89.98% di accuratezza! Questo confermava che unire le forze pagava.

E con l’aggiunta dei dati generati dalle GAN? L’accuratezza è salita ulteriormente:

- Con dati da DCGAN: 90.28%

- Con dati da PGGAN: 93.68%

Un risultato strepitoso! Il 93.68% di accuratezza nell’identificare automaticamente il tipo corretto di frattura vertebrale tra tante classi complesse è un passo avanti notevole. Ha anche confermato che le immagini generate da PGGAN, essendo di qualità superiore e create progressivamente, erano più efficaci per l’addestramento rispetto a quelle DCGAN. Abbiamo persino fatto valutare le immagini sintetiche ai chirurghi spinali, e hanno confermato la maggiore chiarezza e precisione delle fratture generate da PGGAN.

Perché Funziona Così Bene? La Forza dell’Unione

Il successo del nostro modello VGG16-ResNet50-ViT potenziato da PGGAN non è casuale. Deriva dalla combinazione strategica di diversi punti di forza:

- VGG16 e ResNet50: Eccellono nell’estrarre caratteristiche locali dettagliate (features) come bordi, texture, linee sottili di frattura. ResNet50, con le sue “scorciatoie” (residual connections), è particolarmente bravo a gestire reti profonde senza perdere informazioni.

- ViT: Grazie al meccanismo di auto-attenzione (self-attention), cattura le relazioni a lungo raggio e il contesto globale dell’immagine. Capisce la forma generale della vertebra e come la frattura si inserisce nel quadro complessivo.

- Ensemble Pesato: Integra in modo intelligente le previsioni dei singoli modelli, dando più peso a quello che si dimostra più affidabile (in questo caso, probabilmente il ViT per la sua visione globale, ma bilanciato dagli specialisti dei dettagli). Questo riduce i bias dei singoli modelli e migliora la robustezza generale.

- Augmentation con PGGAN: Fornisce dati di addestramento sintetici ma estremamente realistici e diversificati. Questo aiuta il modello a generalizzare meglio (cioè a funzionare bene anche su immagini mai viste prima), a gestire lo squilibrio tra le classi e a comprendere pattern complessi presenti nei diversi tipi di frattura.

In pratica, abbiamo creato un sistema AI che sa guardare sia i dettagli microscopici che il quadro generale, imparando da un set di dati arricchito da esempi realistici generati ad hoc.

Conclusioni e Prospettive Future

Questo lavoro, per me, è stata la dimostrazione che combinando diverse tecniche di intelligenza artificiale (DL classico, Vision Transformers, GAN) si possono affrontare sfide mediche complesse come l’identificazione dei tipi di frattura vertebrale. Raggiungere un’accuratezza del 93.68% con il nostro modello ensemble pesato e i dati PGGAN è un risultato che ci rende orgogliosi e che apre scenari interessanti.

Immaginate un futuro in cui un sistema come questo possa assistere i radiologi, fornendo una “seconda opinione” rapida e affidabile, aiutando a velocizzare la diagnosi e, di conseguenza, il trattamento per i pazienti. Certo, la strada è ancora lunga: bisogna ottimizzare l’efficienza computazionale (questi modelli sono “pesanti”!) ed estendere i test ad altre modalità di imaging o ad altre problematiche mediche.

Ma la direzione è tracciata: l’intelligenza artificiale, usata con criterio e in sinergia con l’esperienza umana, ha il potenziale per rivoluzionare davvero la medicina diagnostica. E io non vedo l’ora di continuare a esplorare queste frontiere!

Fonte: Springer